Индустрия AI окончательно перешла от «умных чат-ботов» к автономным инженерным системам. Прошедшие недели подсветили три главных вектора: агенты становятся самостоятельными инженерами, железо мимикрирует под запросы LLM, а большие деньги уходят в системную интеграцию.

SambaNova о гибридной AI-архитектуре для агентного инференса

На GTC 2026 keynote NVIDIA показал график System Throughput (Y) vs Speed (X) — SambaNova соглашается, что будущее AI-железа сводится к этой зоне, как при запуске их SN50 RDU пятого поколения.

Агенты хотят скорости в token-efficient режиме для concurrent-запросов, попадая в Goldilocks Zone. Prefill (вычислительно тяжелый этап: параллельно обрабатывают промт и строят KV-cache, от него зависит TTFT) отдают на GPU вроде Rubin CPX. Decode (ограниченный памятью: генерируют токены по одному, читая model weights и KV-cache) берет RDU с упором на memory bandwidth.

Очередная крутая статья от SambaNova — да, это в том числе маркетинг под их чипы, но под ним есть весомое основание: схема «Prefill + Decode» уже показала эффективность, что позволяет рационально разделить вычислительные блоки по фазам, а позиция разработчиков собственного железа заслуживает внимания.

SambaNova RDU на Dataflow Architecture с многоуровневой памятью — SRAM ускоряет слияние операций при генерации токенов, HBM хранит веса модели и KV-cache, DDR кэширует длинные промты агентов. Это тянет модели с триллионом параметров на одном SambaRack при 20 кВт (против 1+ МВт и 2 000+ чипов Groq).

Системы легко перестраиваются под разные нагрузки, ставятся в любой ЦОД. Провайдеры инференса уже интегрируют SambaStack в свои платформы, а Middle-разработчики тестируют SN40L прямо в SambaCloud с моделью MiniMax.

Дефицит памяти добралcя до Mac mini

Бюджетный Mac mini за $600 официально ушел в историю. Из-за кризиса полупроводников и роста цен на компоненты Apple сняла с производства базовую модель на 256 ГБ. Теперь линейка начинается с 512 ГБ за $800.

Причин две: низкая рентабельность младшей версии и ажиотажный спрос со стороны разработчиков, которые массово скупают «миники» под локальный инференс AI-моделей.

В результате цены в ритейле подскочили: в Европе база стоит от 950 €, а в России остатки старых версий торгуются в районе 70–75 000 рублей. Звание самого доступного устройства Apple теперь переходит к MacBook Neo.

Самое главное с NVIDIA GTC 2026

Это одно из важных событий года в индустрии. Помимо гибридного железа SambaNova с их фокусом, Дженсен Хуанг подвел итоги 20 лет CUDA — софт сделал GPU general purpose вычислителями, а DGX эволюционировали в Token Factory: ЦОДы превращаются в фабрики токенов, где вход — электричество, выход — интеллектуальные действия агентов (с $1 трлн инвестиций к 2027).

Анонсы: модульная Vera Rubin под инференс (Groq LPU для скорости токенов), NemoClaw — стек для enterprise-агентов с корпоративной безопасностью, и переход SaaS → AaaS, где бизнес платит за результат агента, а не подписку.

Более подробно (если лень смотреть трехчасовой keynote) с комментариями директора AI-вертикали Selectel — в обзоре.

Tavily: специализированный поиск для AI-агентов

Для тех, кто собирает research-агентов, появилось готовое решение, заменяющее самописный парсинг. Tavily — это Search API, который объединяет поиск в реальном времени, очистку контента и краулинг в одном вызове.

Если вы используете агентов для сбора информации, это прямая замена MCP от Perplexity: сервис дает 1 000 бесплатных запросов в месяц, чего хватит на четыре–пять глубоких исследований (один запрос типа advanced равен трем обычным).

Технические детали

- Архитектура. Сервис построен на связке Jina Reader и LlamaIndex. На выходе получается очищенный от мусора JSON, готовый для LLM и валидации через Pydantic.

- Инструменты. Эндпоинт /research генерирует отчеты с источниками, /extract парсит пачку URL за раз, а /crawl индексирует сайты.

- Эффективность. Интеграция занимает пару строк кода. В тестах на RAG-задачах точность извлечения данных достигает 92%, что заметно выше показателей стандартных поисковых API.

Сервис экономит токены и время на разработку собственных обходчиков блокировок, предоставляя нативную поддержку для LangChain и LlamaIndex.

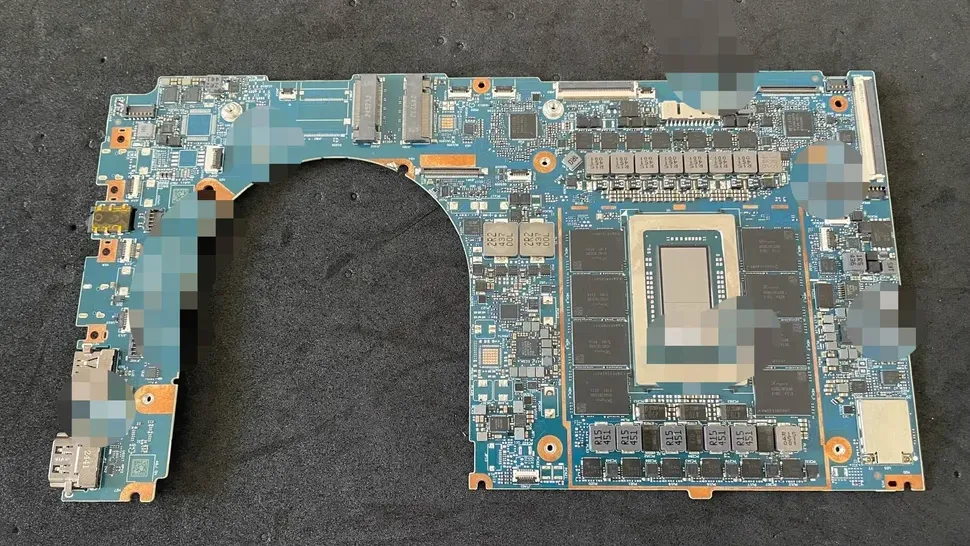

NVIDIA N1/N1X: «зеленый» ответ на AMD AI Max

NVIDIA явно не дают покоя лавры Apple Silicon и будущих AMD AI Max. Утечка материнской платы подтверждает разработку платформы N1/N1X для мини-ПК и 14-дюймовых ноутбуков. Это первый потребительский CPU компании со времен Tegra X1 (2015), созданный в партнерстве с MediaTek.

Внутри — 20-ядерный ARM-процессор и графика уровня RTX 5070 (6 144 ядра CUDA) на архитектуре Blackwell. Но главная деталь здесь — 128 ГБ единой памяти (Unified Memory) со скоростью 8 533 MT/с. Это быстрее, чем у грядущих AMD Strix Halo, и уровень Apple M5. Технически перед нами попытка упаковать «суперчип» GB10 из серверных систем DGX Spark в корпус лэптопа за примерно $1 400.

Если вы тоже следите за темой Physical AI и линейкой Jetson, то возникает вопрос: как NVIDIA будет их разводить? Похоже, N1 станет массовой платформой для AI-ноутбуков и мощного «железа на стероидах», где нужна полноценная CUDA под Windows-on-ARM.

Пока Qualcomm буксует с драйверами, NVIDIA просто заполняет пустую нишу идеальной станцией для локального запуска тяжелых моделей. Ждем анонсы на Computex и первые девайсы от Dell и Lenovo к 2026 году.

Intel и SambaNova: зачем агентам разные чипы

В продолжение темы агентского тулинга — интересная новость от Intel и SambaNova. Они представили гетерогенную платформу для инференса, которая подтверждает важный тезис: оркестрацию и логику агентов вовсе не обязательно «вешать» на GPU.

Как это работает: партнеры предложили разделять инференс на этапы и распределять их по разному «кремнию». Пока мощные AI-ускорители (GPU) занимаются тяжелой работой — поглощают длинные промты и строят KV-кэши, за генерацию токенов отвечает специализированный чип SambaNova SN50 RDU.

Но самое интересное в этой связке — роль Intel Xeon 6. Процессор берет на себя всю «агентскую» нагрузку: компиляцию и выполнение кода, валидацию ответов, координацию рабочих нагрузок и общую оркестрацию. По сути, Intel нашел применение своим мощным CPU в эпоху засилья графических чипов, превратив их в идеальный «мозг» для управления агентами.

Это логичный подход: GPU хорош в вычислениях, но для сложной логики и выполнения кода классическая архитектура процессоров все еще эффективнее.

MLOps 101: база процессов от NVIDIA

Если вы искали гайд по тому, как устроена «кухня» развертывания моделей, то это он. Видео полностью оправдывает приставку «101» в названии: в нем удалось собрать все базовые концепции MLOps — от выбора платформы до выстраивания пайплайнов.

Доклад не претендует на звание энциклопедии, но как отправная точка для формирования структуры знаний — отличный вариант. Если в процессе встретятся незнакомые термины (а их в MLOps всегда хватает), их легко догуглить по ходу дела. Хороший старт, чтобы перестать путаться в процессах и инструментах оркестрации.

От теории MLOps к практике: K8s и динамические GPU

В продолжение темы процессов — прикладной анонс для тех, кто администрирует инфраструктуру под модели. Напомню, что в версии Kubernetes 1,36 механизм DRA (Dynamic Resource Allocation) уже должен выйти в стабильный релиз. Видимо, специально под это событие ребята из CNCF выпустили свежий полуворкшоп-полутуториал по теме «DRA-matically Simple».

DRA — это долгожданная фича, которая позволяет K8s управлять ускорителями (GPU) так же гибко, как памятью или CPU. Раньше видеокарты были жестко привязаны к нодам, а теперь ресурсы можно выделять по запросу (On-Demand).

Для MLOps-пайплайнов это киллер-фича, позволяющая не «сжигать» бюджет на простаивающее железо. Я такие разборы очень люблю и вам советую посмотреть, чтобы подготовить инфраструктуру к обновлению.

ElevenLabs уходит в локальный инференс

ElevenLabs, долгое время бывшие исключительно облачным сервисом, наконец анонсировали возможность локального развертывания своих моделей.

Платформа открыла ранний доступ к двум вариантам деплоя:

- On-Premise — для стандартных серверных мощностей с GPU;

- On-Device — облегченная версия для edge-устройств, ARM-чипов и систем с NPU (привет, AI-ноутбуки).

Инференс и обработка аудио теперь могут полностью происходить внутри закрытого контура клиента на более чем 30 языках — это важно для энтерпрайза. Приятно, что лицензионная валидация и телеметрия заявлены как опциональные — это позволит разворачивать модели даже в полностью изолированных (air-gapped) средах.

Также обещают возможность дообучения под специфические диалекты и контролируемый график обновлений. По срокам: запуск намечен на первую половину 2026 года, пока открыта запись в лист ожидания. Тарификация будет гибридной: фиксированная лицензия плюс оплата за использование.

Как KIMI K2,6 за ночь обогнала LM Studio на Mac

В блоге разработчиков выложили отчет, который кажется байкой ради хайпа, но это реальный лог того, как модель работала сама по себе.

Ситуация такая: модель сама, без человека, решила запустить Qwen 3,5-0,8B у себя на Mac. Дефолтный инференс ее не устроил, поэтому она села писать свой рантайм.

Причем выбрала не Python или C++, а Zig. В итоге — 12 часов работы, 14 итераций кода, более 4 000 вызовов инструментов, и все заработало.

Результат впечатляет: скорость генерации выросла с 15 до 193 токенов в секунду. Это в 12 раз быстрее базы и на 20% быстрее LM Studio, которую сообщество годами оптимизировало под локальный запуск.

Для нас это важный маркер. Одно дело — выбивать SOTA в бенчмарках SWE-bench или математике (хотя там у K2,6 все очень прилично), и совсем другое — когда агент за ночь берет системный язык и переписывает чужой софт так, что обходит популярный продукт. Мы переходим от этапа простых скриптов к глубокой системной оптимизации силами нейросетей.

Веса уже на Hugging Face, а API доступно у Moonshot.

SpaceX «покупает» Cursor

SpaceX планирует приобрести сервис Cursor, что выглядит как масштабный стратегический ход в рамках подготовки к выходу на биржу.

Бизнес-империя Илона Маска заключила соглашение с разработчиком Anysphere. По сути, это опцион, который дает право выкупить стартап за $60 млрд до конца года либо выплатить $10 млрд за партнерство без поглощения. Такой формат позволяет не обременять баланс SpaceX крупной покупкой непосредственно перед IPO.

Сделка ложится в логику объединения космических активов SpaceX и AI-ресурсов xAI в единую структуру. Для рынка готовится предложение конгломерата с оценкой около $2 трлн, где ракетные технологии дополнены мощной AI-экосистемой. Приобретение Cursor закрывает дефицит собственных решений xAI в области кодинг-агентов, где сейчас доминируют Anthropic и OpenAI.

Интеграция лидирующего кодинг-сервиса с вычислительными мощностями суперкомпьютера Colossus и моделями Grok должна усилить позиции Маска в самом востребованном сегменте AI. Если связка окажется эффективной, это создаст серьезную конкуренцию текущим лидерам рынка и может подтолкнуть их к пересмотру лимитов в своих продуктах.

OpenAI создала отдельную компанию для внедрения AI-агентов в бизнес

Пока разработчики моделей бьются за бенчмарки, на рынке системной интеграции начинается передел. OpenAI совместно с SoftBank и консалтинговыми гигантами основали The Deployment Company — структуру с оценкой в $10 млрд, которая займется массовым внедрением AI-агентов в корпорации.

Проект уже привлек более $4 млрд инвестиций — и это не просто очередной раунд, а создание сервисной машины для «приземления» технологий в энтерпрайз.

Синхронный запуск аналогичного предприятия от Anthropic подтверждает тренд: гонка вооружений переместилась из лабораторий в плоскость реального внедрения. Теперь вопрос не в том, чья модель умнее, а в том, кто быстрее выстроит процессы и научит агентов работать внутри сложившихся бизнес-структур.