Если вы ждали от мартовского кейноута Дженсена Хуанга просто «железок» помощнее, то вы ошиблись дверью. Да, были новые чипы, но за всем этим скрывалось нечто большее. Знаете это чувство, когда мир меняется прямо у вас на глазах, как когда-то это было с интернетом? Это был тот самый момент.

Прошедший NVIDIA GTC был не типичной трансляцией ради рекламы видеокарт. Хуанг подвел логичную черту над первыми двадцатью годами существования CUDA. Наконец, мы увидели, как бизнес движется в сторону новых концепций вроде Agent as a Service, Token Factory, модульной архитектуры железа и не только. И не переживайте, если вы слышите про них впервые — это нормально.

Привет, Хабр! Меня зовут Александр Тугов, я директор AI-вертикали в Selectel. В этой статье хочу структурировать основные тезисы, озвученные в кейноуте NVIDIA GTC, и поделиться своими мыслями.

20 лет с момента появления CUDA

Удивительно: технология CUDA была представлена почти 20 лет назад. Именно она когда-то закрепила лидерство NVIDIA на рынке GPU и позволила видеокартам стать вычислителями общего назначения, или, как говорят, General Purpose.

Если бы тогда, в середине нулевых, NVIDIA не сделала ставку на софт и библиотеки, сегодня никакой AI-гонки бы не было. Доминирование «зеленых» сейчас — это не только (и не столько) транзисторы, а CUDA X и гигантский портфель готовых решений. Без этого слоя даже самый мощный чип остается просто дорогим кремнием. Как верно подметил Дженсен: «We are an algorithm company. That’s what makes us special». И это правда: они продают не железо, а возможность запустить на нем готовые прикладные решения из портфеля библиотек CUDA X.

Кроме того, десять лет назад первый DGX стал точкой невозврата. NVIDIA тогда четко дала понять: AI требует своего, особенного железа. Сегодня мы видим финал этой эволюции — когда отдельные серверы DGX превратились в модульные элементы глобальных «фабрик токенов», а вычислительная мощность стала измеряться не флопсами, а стоимостью генерации одного осмысленного действия AI-агента.

Вершина эволюции AI: OpenClaw

Все, что строили эти 20 лет, привело к появлению OpenClaw. Это вершина эволюции AI на текущий момент. Развитие шло поэтапно: сначала модели просто генерировали контент, затем научились рассуждать (reasoning), а ClawCode в связке с OpenClaw дал им полноценный I/O-интерфейс для взаимодействия с внешним миром. У цифрового «мозга» наконец появились «глаза, уши и руки». Это переход от чат-ботов к автономным агентам, способным выполнять реальную работу в физической и цифровой среде.

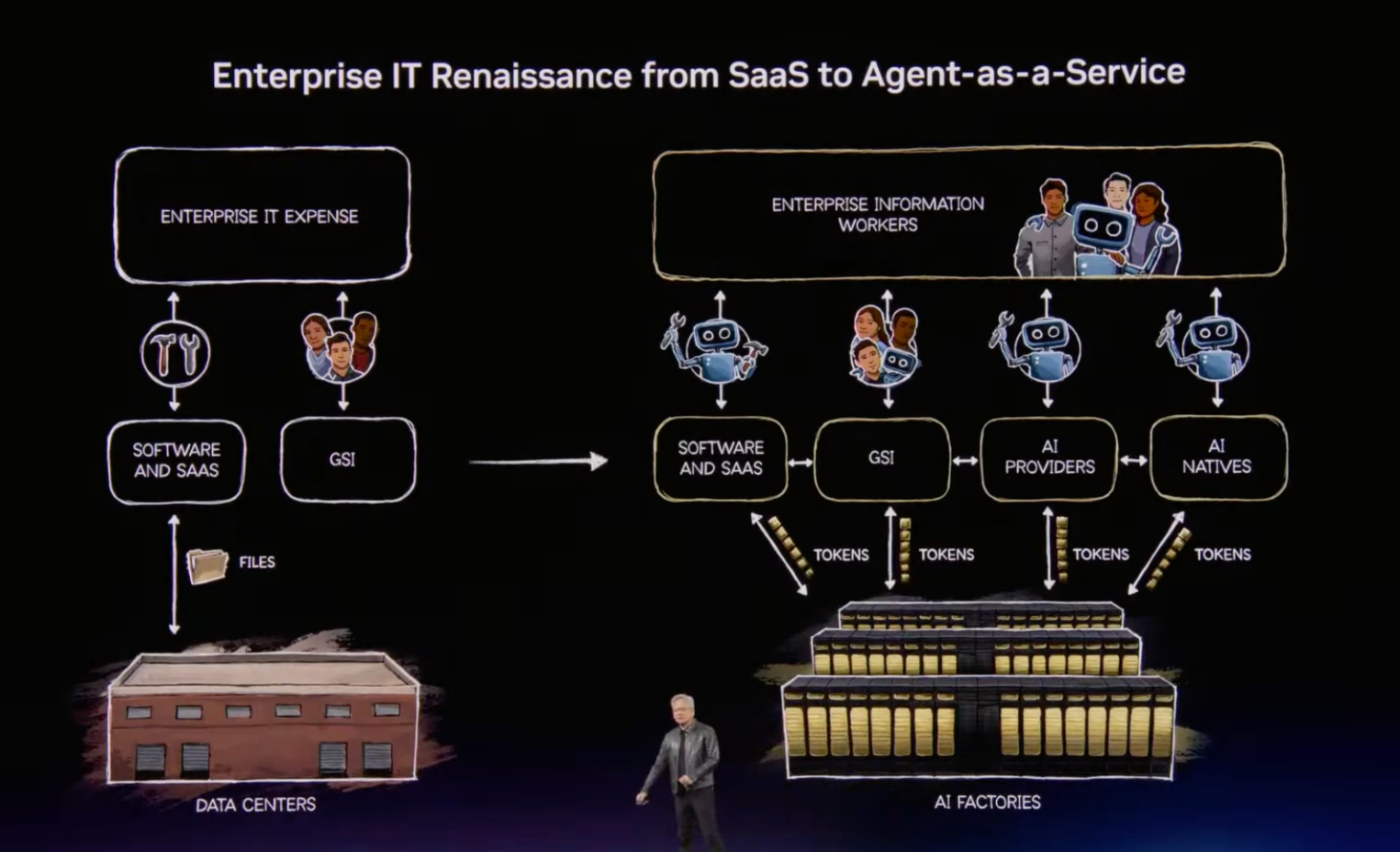

IT-ренессанс: AaaS как замена SaaS

Если AI работает — он приносит бизнесу деньги так же, как и люди. Это меняет саму бизнес-модель: мы переходим от продажи софта (SaaS) к продаже «действий агентов» (Agent-as-a-Service, AaaS). Главный экономический манифест Хуанга в том, что программное обеспечение — это больше не инструмент, который вы используете. Это коллега, которому вы поручаете задачу.

В модели SaaS компания платит за доступ к функциям, а работу выполняет человек. В новой реальности Agent-as-a-Service бизнес платит за результат (outcome). Правильно отмечено, что наступил фундаментальный перелом: «…fundamental inflection. Finally, AI is able to do productive work, and therefore, the inflection point of inference has arrived». По сути, мы переходим в эпоху индустриализации интеллекта, когда агенты перестают быть «галлюцинирующими чат-ботами» и становятся неотъемлемой частью промышленных систем.

Концепция Token Factory

Так называемая «индустриализация интеллекта» — сквозная тема GTC 2026, и дальше вы поймете это в еще более полной мере. Вводится новая концепция — Token Factory. Что это?

Если раньше дата-центры были местом для хранения и обработки данных, то сегодня Дженсен предлагает смотреть на них как на фабрики (AI Factories). Это не просто метафора. Это описание новой экономики, где входным сырьем является электричество, а конечным продуктом — токены.

Токен в 2026 году — это не только единица текста. Это единица «интеллектуального действия» AI-агента. Поскольку агенты начинают выполнять реальную работу в бизнесе, потребность в таких токенах растет в геометрической прогрессии.

Как это работает

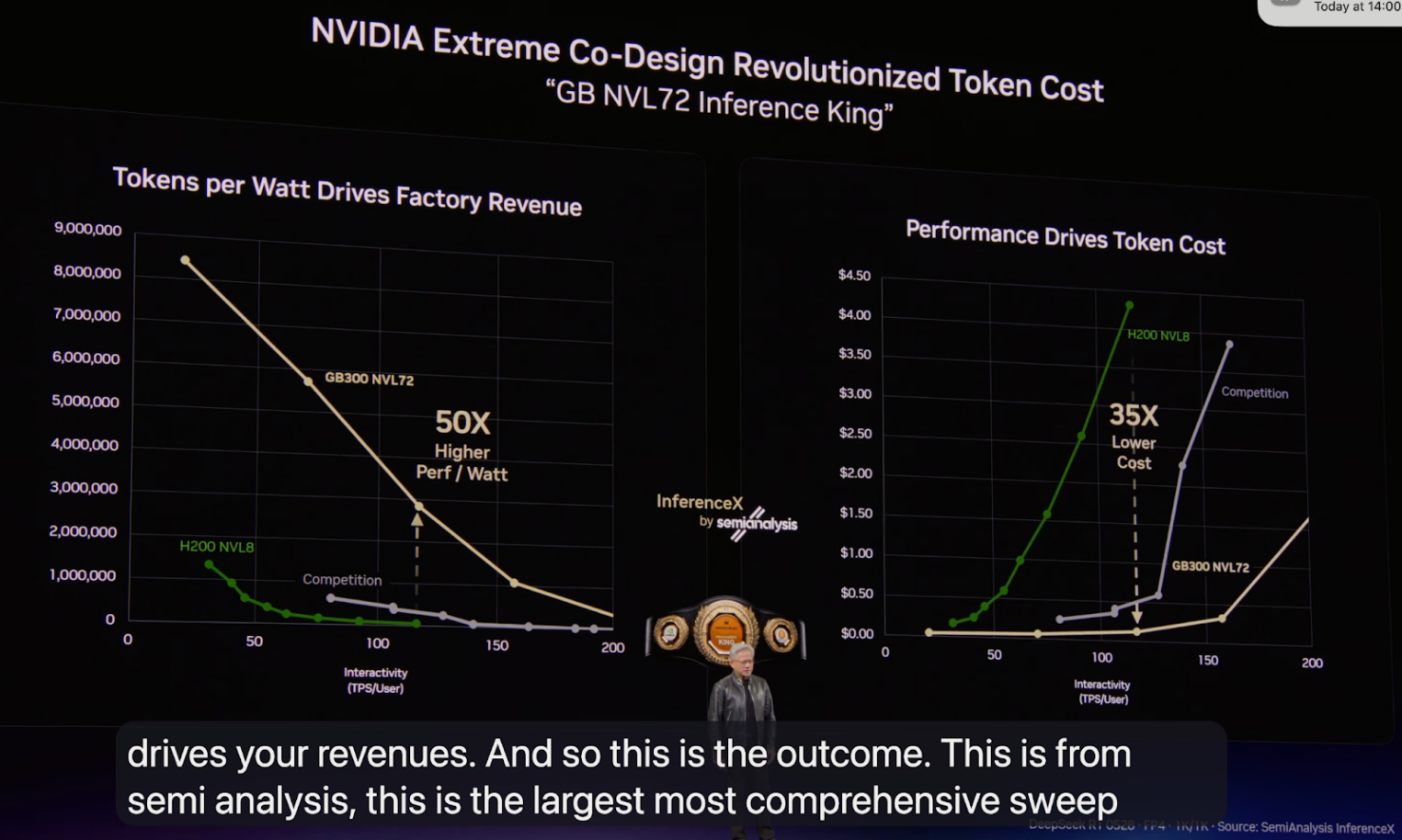

Современный ЦОД на базе архитектуры Blackwell и грядущей Vera Rubin оптимизирован под одну задачу — выдать максимальное количество осмысленных токенов на каждый потребленный ватт, который стоит денег. И цифры, озвученные Хуангом, подтверждают серьезность намерений: к 2027 году суммарный бюджет на строительство и модернизацию таких «фабрик» по всему миру достигнет $1 триллиона.

Но откуда потребность в столь больших инвестициях? Должна быть полезная нагрузка. Во время выступления Дженсен справедливо отметил, что двигателями фабрик все чаще становятся открытые LLM: «…open source models have reached near the frontier, and it is literally everywhere». И здесь всему виной open source, в хорошем смысле.

Время модульной архитектуры

Инференс — это сложно. Повторю это, процитировав Дженсена: «Inference is ultimate hard, it is ultimate important». И с этим сложно поспорить. Если обучение модели — это разовый (пусть и дорогой) акт творения, то инференс — это ежедневная эксплуатация, которая и «качает» экономику AI-фабрик.

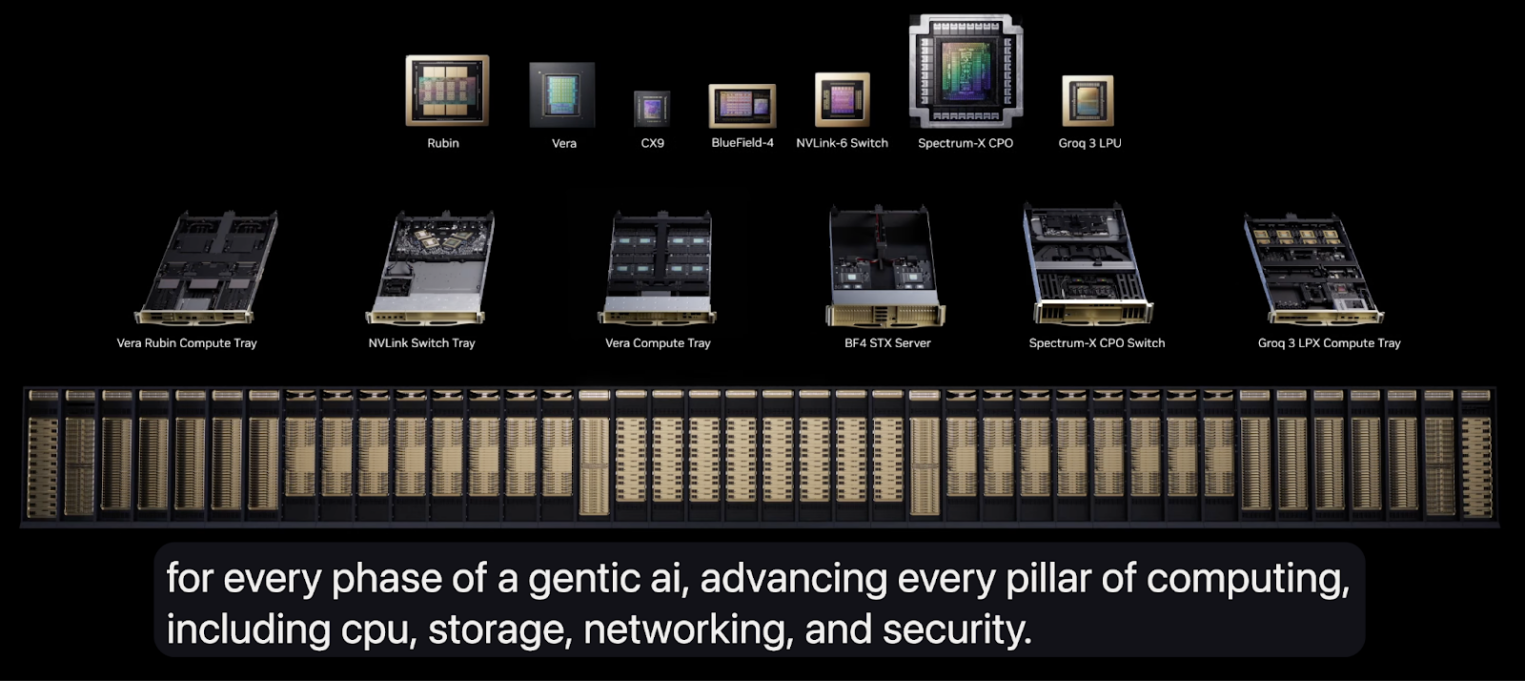

Архитектура Vera Rubin была представлена как прямой ответ на эту сложность. Это не просто очередной прирост флопсов, а глубокая оптимизация каждого этапа прохождения данных через железо.

Ключевые особенности Vera Rubin

Модульность под нагрузку. Архитектура позволяет гибко конфигурировать инсталляции под конкретные задачи бизнеса. Больше нет «универсального сервера для всего» — есть кастомизация под специфические рабочие нагрузки.

Хуанг транслировал идею, что в новую эпоху AI бессмысленно обсуждать отдельный процессор или видеокарту. Продуктом NVIDIA теперь является вся стойка целиком, где каждый компонент оптимизирован под одну цель — ультимативный инференс для агентов.

При этом NVIDIA контролирует весь путь прохождения данных: вычисления, утилизацию CPU, хранение данных, сетевые взаимодействия и безопасность. Особое внимание — CPO, без которой концепция Token Factory невозможна. Технология позволяет пробрасывать данные между стойками через оптические соединения, с минимальными задержками.

Самое интересное в этом списке — упоминание Groq 3 LPU. Интеграция их в Vera Compute Tray означает, что NVIDIA создает гибридную систему: мощь Rubin для сложных рассуждений и скорость Groq для мгновенной выдачи токенов.

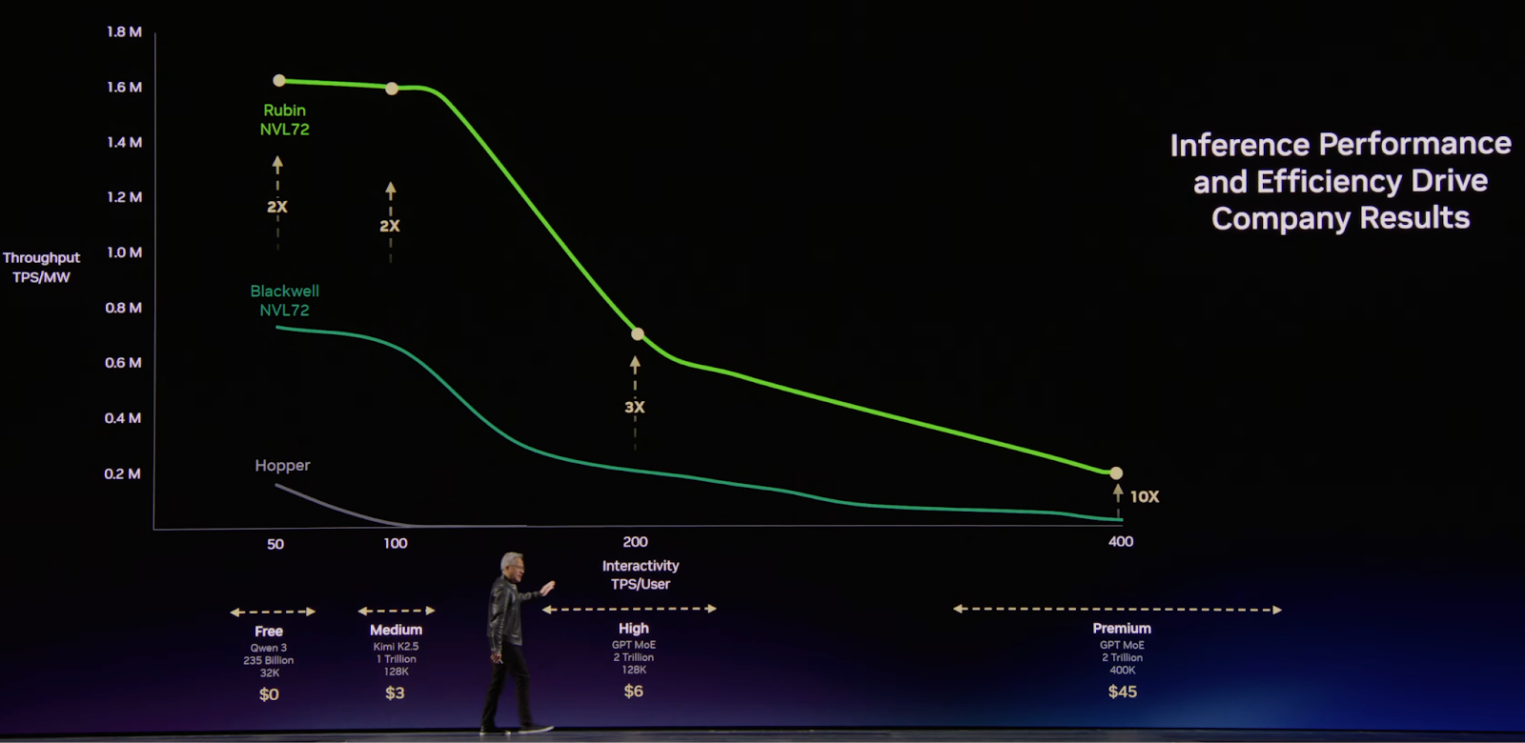

Связь размера и качества. Дженсен подчеркнул прямую зависимость: размер модели → качество токенов → тир инференса. Это рождает новую рыночную сегментацию: от Free (быстрые, массовые ответы) до Premium (глубокий reasoning на тяжелых моделях в реальном времени).

Комплексный охват. Vera Rubin обновляет каждый столп вычислений — от CPU и подсистемы хранения до сетевых протоколов и безопасности. Все это нужно, чтобы обеспечить работу «физического» AI на каждом этапе.

«Inference drives your revenues. And so this is the outcome» — емкий итог от Дженсена. Эффективный инференс — это не техническая метрика, это база вашего P&L.

NVIDIA также показали график, который ставит точку в споре о целесообразности перехода на новое железо. Сравнивая Throughput (эффективность на мегаватт) и Interactivity (скорость для пользователя), он продемонстрировал, что архитектура Vera Rubin ломает классический компромисс. Мы наконец получили систему, которая может выдавать сотни токенов в секунду для каждого агента, не превращая при этом счета за электричество в астрономические суммы. Это и есть технический фундамент для экономики Agent-as-a-Service

NemoClaw — архитектура внедрения агентов

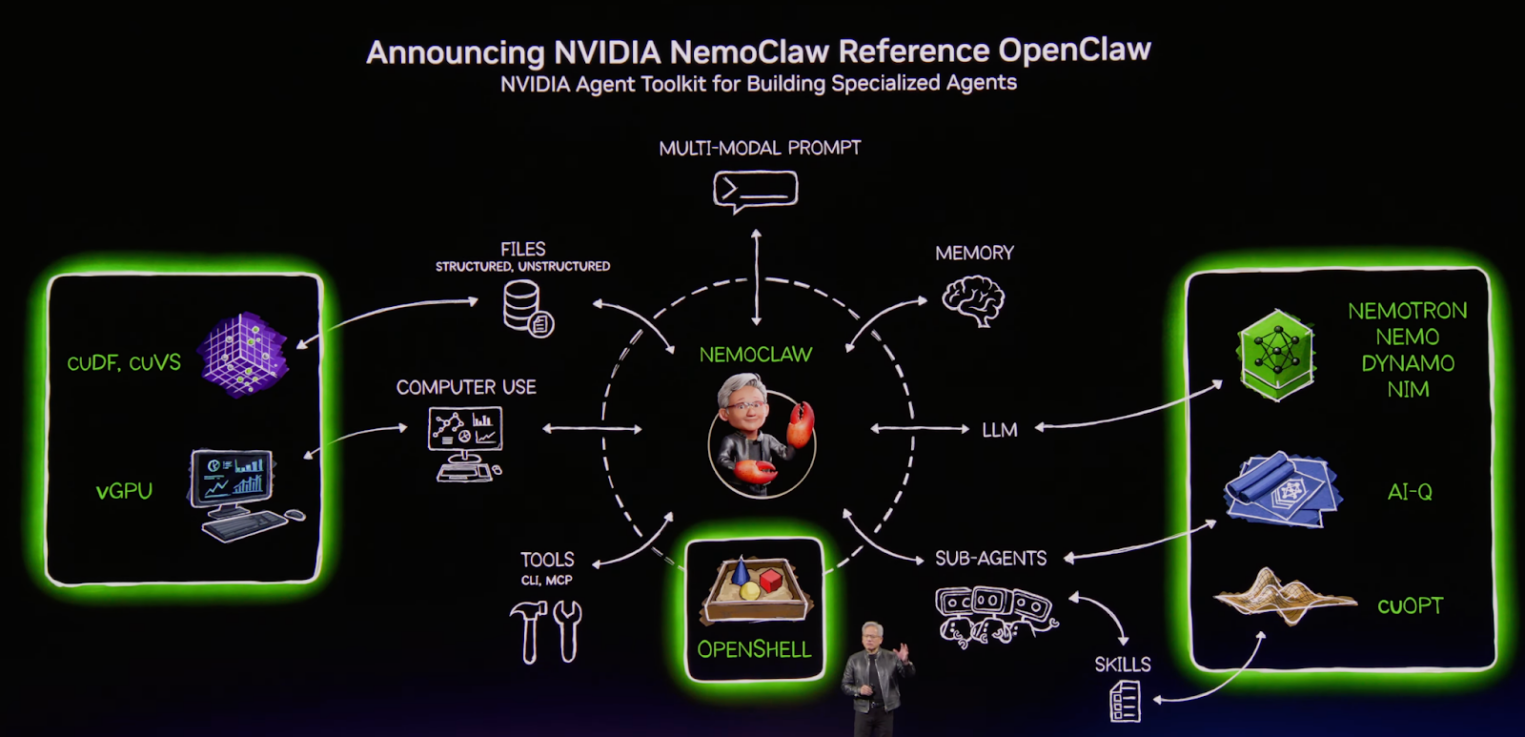

Как мы уже обсуждали, OpenClaw появился в идеальный момент. Он фактически трансформирует реализацию потребностей бизнеса из классического SaaS в Agent-as-a-Service. Однако у корпораций есть специфические требования к безопасности, управляемости и предсказуемости, которым «голый» OpenClaw не всегда соответствует.

Чтобы закрыть этот пул вопросов, NVIDIA представила NemoClaw — референсную архитектуру для внедрения AI-агентов в большой бизнес. По сути, это «заводской» стандарт того, как накладывать программный стек NVIDIA поверх платформы автономных агентов. NemoClaw гарантирует, что агент будет работать в рамках корпоративных политик, иметь доступ только к разрешенным I/O-интерфейсам и бесшовно интегрироваться в существующий IT-ландшафт компании.

Заключение

Последний кейноут GTC получился по-настоящему интересным. Дженсен всеобъемлюще обозрел ситуацию на рынке AI-агентов и показал, куда все движется. Реальность такова, что концепции вроде Agent-as-a-Service или Token Factory заработали в продакшене, «просто облака» уже недостаточно. Именно поэтому мы в Selectel сейчас фокусируемся на развитии решений для инференса.

Лично я чувствую, что весь этот «IT-ренессанс» сравним по значимости с появлением первых персональных компьютеров, интернета и смартфонов вместе взятых. Мы наблюдаем полное переосмысление роли человека в экономике и науке. Сингулярность и трансгуманизм, о которых десятилетиями спорили фантасты, постепенно переезжают из книг в серверные стойки.