Процессоры

Intel Xeon 600 для рабочих станций

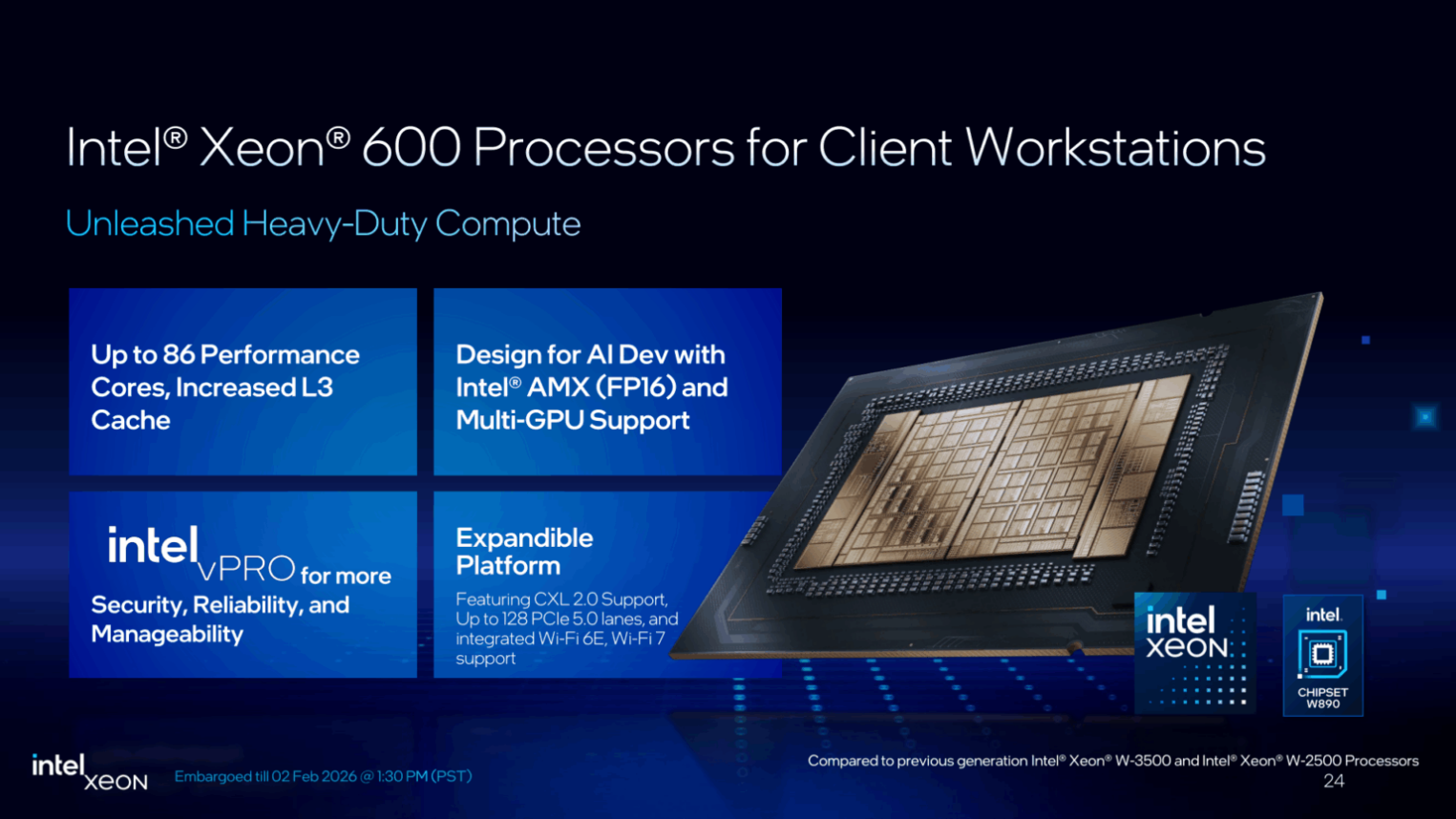

Intel обновили линейку CPU для рабочих станций и представили семейство Xeon 600 на архитектуре Granite Rapids. Новые чипы заменяют Xeon W-2500 и W-3500, которые базировались на Sapphire/Emerald Rapids. Главное отличие – заметный рост числа ядер памяти.

Сегмент у этих процессоров довольно узкий: рабочие станции можно использовать для рендеринга, инженерных расчетов и анализа данных. Здесь себя комфортно чувствуют AMD Threadripper, поэтому Xeon 600 — очередная попытка Intel конкурировать с соперником.

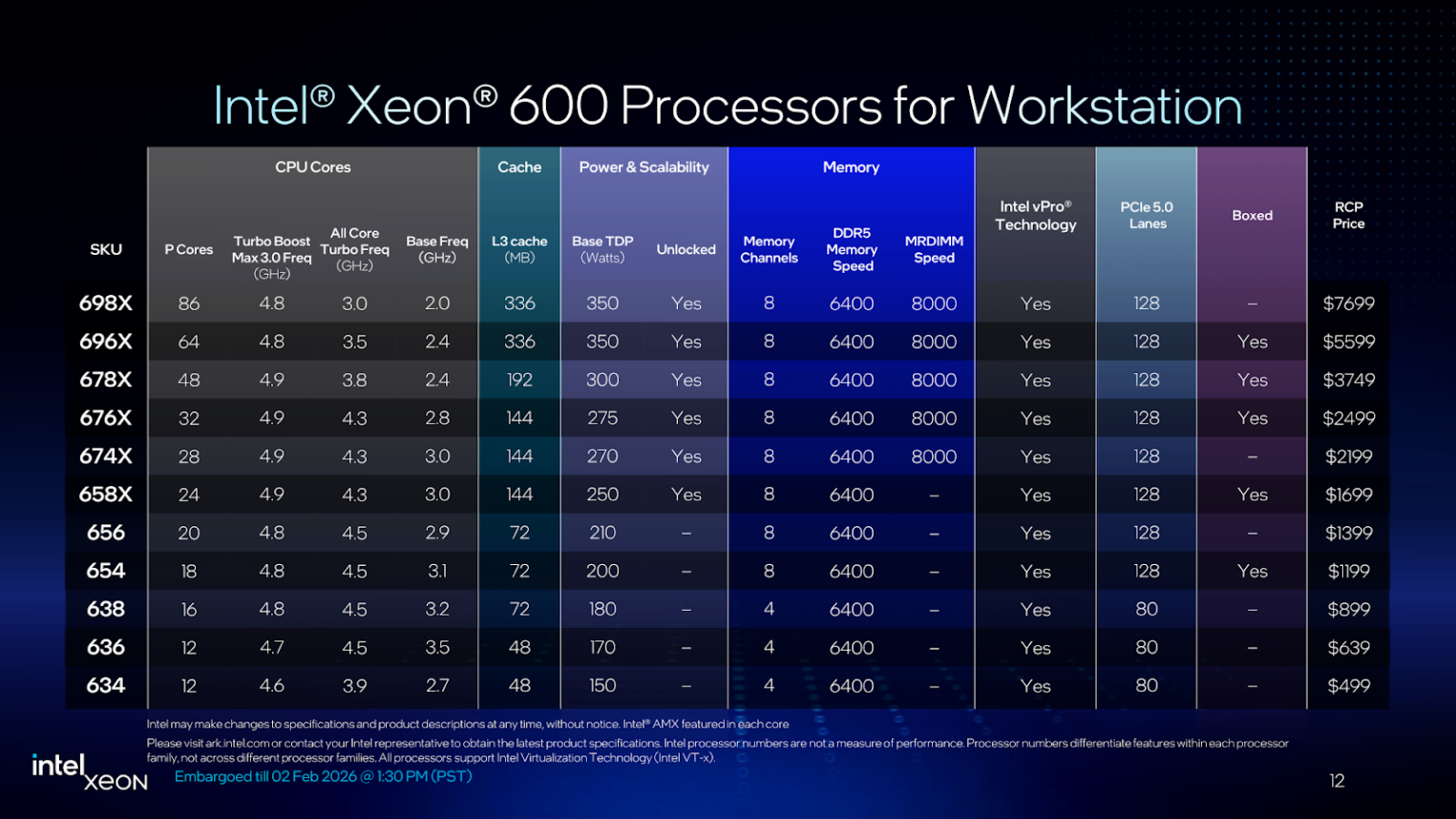

В основе процессоровов лежат ядра Redwood Cove, в количестве от 12 до 86. Для сравнения: топовые Xeon W-3500 ограничивались 60 ядрами. В отличие от десктопной линейки Core или старшей линейки серверных Xeon 6, Intel использует только один тип ядер — производительные P-cores. Никаких E-ядер, снижения производительности и экономии электричества. В связи с этим поддержка Hyper-Threading сохраняется, поэтому максимальная конфигурация обрабатывает до 172 потоков.

Основные параметры

- Базовая частота: 2,0–3,5 ГГц

- Турбо-частота: 4,6–4,9 ГГц

- L3-кэш: 48–336 МБ

- TDP: 150-350 Вт

| Xeon 630 (начальный уровень) | Xeon 650 / 670 / 690 |

| четыре канала DDR5 | восемь каналов DDR5 |

| до 80 линий PCIe 5.0 | до 128 линий PCIe 5.0 |

Поддерживаются модули RDIMM-6400, а старшие модели (670/690) умеют работать с MRDIMM-8000. При этом максимальный объем оперативной памяти — до 4 ТБ. Есть также поддержка CXL 2.0 — технологии, которая позволяет расширять память через внешние устройства.

Кроме того, обновился чипсет до W890 и блок Intel AMX, который теперь способен на FP16-вычисления, что полезно для ML-нагрузок и аналитики. По сравнению с флагманским AMD Threadripper 9995WX у топового Intel Xeon 698X:

- меньше ядер (86 вместо 96),

- меньше потоков (172 вместо 192),

- выше частоты памяти (DDR5-6400 или MRDIMM-8000 против DDR5-5200),

- одинаковый TDP в 350 Вт,

- ниже рекомендованная цена.

Мы в Selectel использовали опередившие свое время и отчасти актуальные до сих пор Intel Xeon W-2255. Однако в новых линейках рабочих станций зачастую проще подобрать комбинацию серверного процессора старшей линейки и соответствующей платформы. Виной тому — дороговизна самих процессоров новой линейки и платформ.

Так, в линейке Intel Xeon 6 с производительными P-ядрами в ряде случаев есть модели с сопоставимыми характеристиками. Например, 6517P из линейки Xeon 6 обладают 16 ядрами и базовой частотой 3,2 ГГц, аналогично модели Intel Xeon 638. При этом рабочая станция дешевле и имеет чуть больший turbo boost, однако необходимость поддержки в дата-центрах еще одной отдельной линейки платформ нивелирует такую экономию. Вдобавок у 6517P есть возможность масштабирования и больше потоков памяти.

В случае с 64 ядрами с Intel Xeon 696X будет конкурировать Intel Xeon 6761P с сопоставимой ценой и незначительно худшими характеристиками. Снова идея использовать преимущества процессоров для рабочих станций и применять их в дата-центре терпит фиаско. Кстати, производители материнских плат и платформ уже объявили о начале производства железа для новых процессоров. Остается только пожелать удачи Intel с сегментом рабочих станций.

Китайские Jintide от Montage Technology на основе Intel Xeon 6

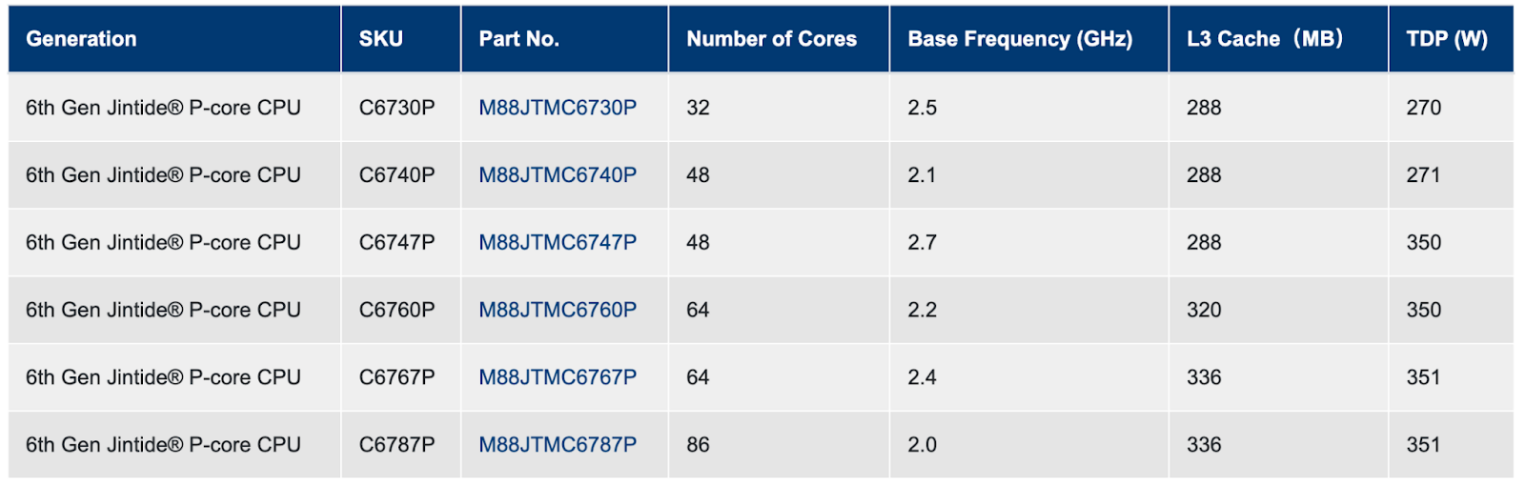

Компания Montage Technology выпустила серверные процессоры Jintide. Речь идет о локализованной версии Intel Xeon 6, адаптированной под требования китайских дата-центров. В линейке — два направления, с производительными ядрами C6P и энергоэффективными C6E.

C6P — производительные CPU на базе ядер P-core

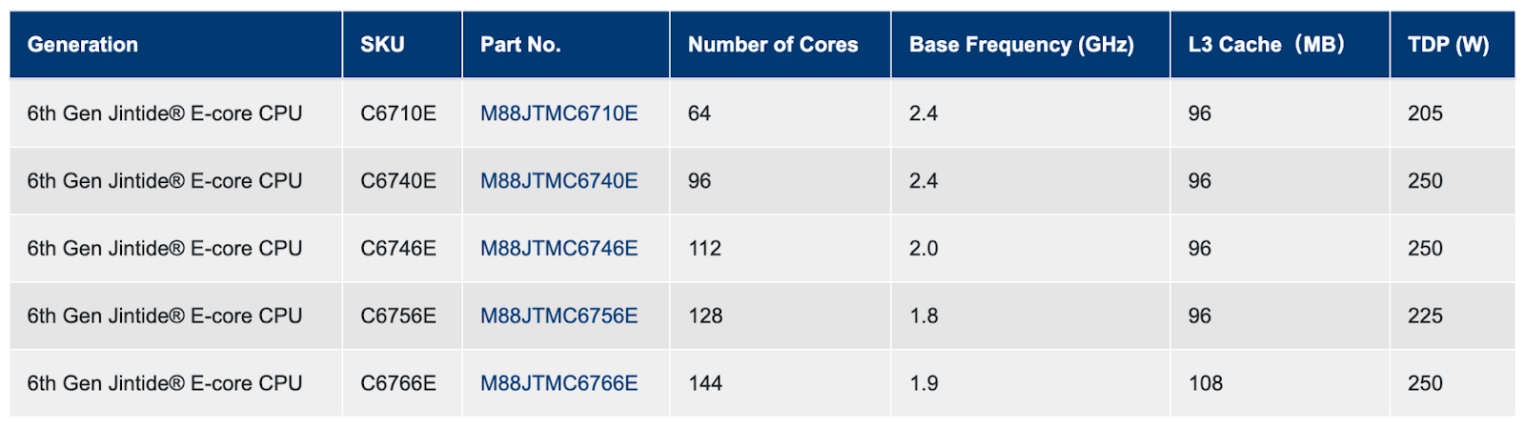

C6E — энергоэффективные модели с E-core

По сути, это переработанные версии Granite Rapids и Sierra Forest, но с локальными модификациями и дополнительными контроллерами безопасности. Отличие — в прошивке и интеграция в китайскую экосистему серверного ПО. Все процессоры возможно использовать в одно и двухсокетной конфигурации.

Jintide C6P основана на архитектуре Intel Granite Rapids-SP, имеет под капотом до 86 P-ядер и 172 потоков, до 336 МБ L3 и 8 каналов DDR5. Поддерживает RDIMM-6400 и MRDIMM-8000, а также — до 88 линий PCIe 5.0 и CXL 2.0. Jintide C6E, в свою очередь, располагает до 144 E-ядер, 108 МБ кэша L3, 8 каналами DDR5-6400, до 88 линий PCIe 5.0 и тем же CXL 2.0.

Серия построена на архитектуре Intel Sierra Forest-SP, рассчитана на облачные нагрузки, микросервисы и контейнерные платформы — там, где важнее количество потоков, а не максимальная частота.

Помимо CPU компания выпустила специализированный контроллер Jintide M88STAR5(N). Внутри — аппаратное шифрование и дешифрование данных, несколько генераторов случайных чисел, пропускная способность до 160 Гбит/с, интерфейс PCIe 5.0 x8 и поддержка TPM / TCM / TPCM. Фактически это аппаратный модуль доверенной среды – аналог серверных security-процессоров, но соответствующий китайским стандартам криптографии.

Ещё один компонент платформы — Jintide M88IO3032. Он выполняет роль классического IOH (I/O Hub) и добавляет периферию: PCIe 3.0, до 20 портов SATA, RAID 0/1/5/10, USB 3.2 и USB 2.0 Для серверных плат это обычная практика: CPU занимается вычислениями, а периферия уходит на отдельный чип.

Jintide C6 — пример того, как китайский рынок адаптирует западные серверные архитектуры под собственные требования. Получается своеобразный гибрид: архитектура Intel, кастомизация под китайскую инфраструктуру, дополнительные чипы безопасности. С технической точки зрения новинки не представляют ничего особенного, но инфраструктурно это важный шаг, попытка собрать полностью контролируемую серверную платформу внутри страны.

Intel Xeon 6+ Clearwater Forest для телеком-нагрузок

На выставке Mobile World Congress 2026 компания Intel продемонстрировала серверные процессоры Intel Xeon 6+ Clearwater Forest. Это следующее поколение энергоэффективных Xeon, ориентированное на облачные платформы и телеком-инфраструктуру.

Главная фишка — плотность ядер: до 288 E-cores на одном процессоре. Для демонстрации Intel объединилась с Ericsson, которая уже тестирует новые CPU в сетевых сценариях. По словам компаний, платформа почти готова к серийному выпуску и должна появиться на рынке в первой половине 2026 года.

Технические характеристики

- До 288 энергоэффективных ядер Darkmont E-core.

- 12 вычислительных чиплетов (Intel 18A).

- До 576 ядер в двухсокетной системе.

- 12 каналов DDR5.

- 96 линий PCIe 5.0.

- 64 линии CXL 2.0.

В тестах Ericsson один Xeon 6990E+ показал примерно +30% производительности по сравнению с двумя Intel Xeon 6780E — и это при меньшем энергопотреблении. Xeon 6+ продолжает линию серверных CPU с большим количеством E-ядер. Такой дизайн подходит для телеком-нагрузок: виртуализированных сетевых функций, edge-узлов и облачных сервисов. В общем, для задач, где больше важна плотность потоков и энергопотребление, чем максимальная частота отдельных ядер.

GPU

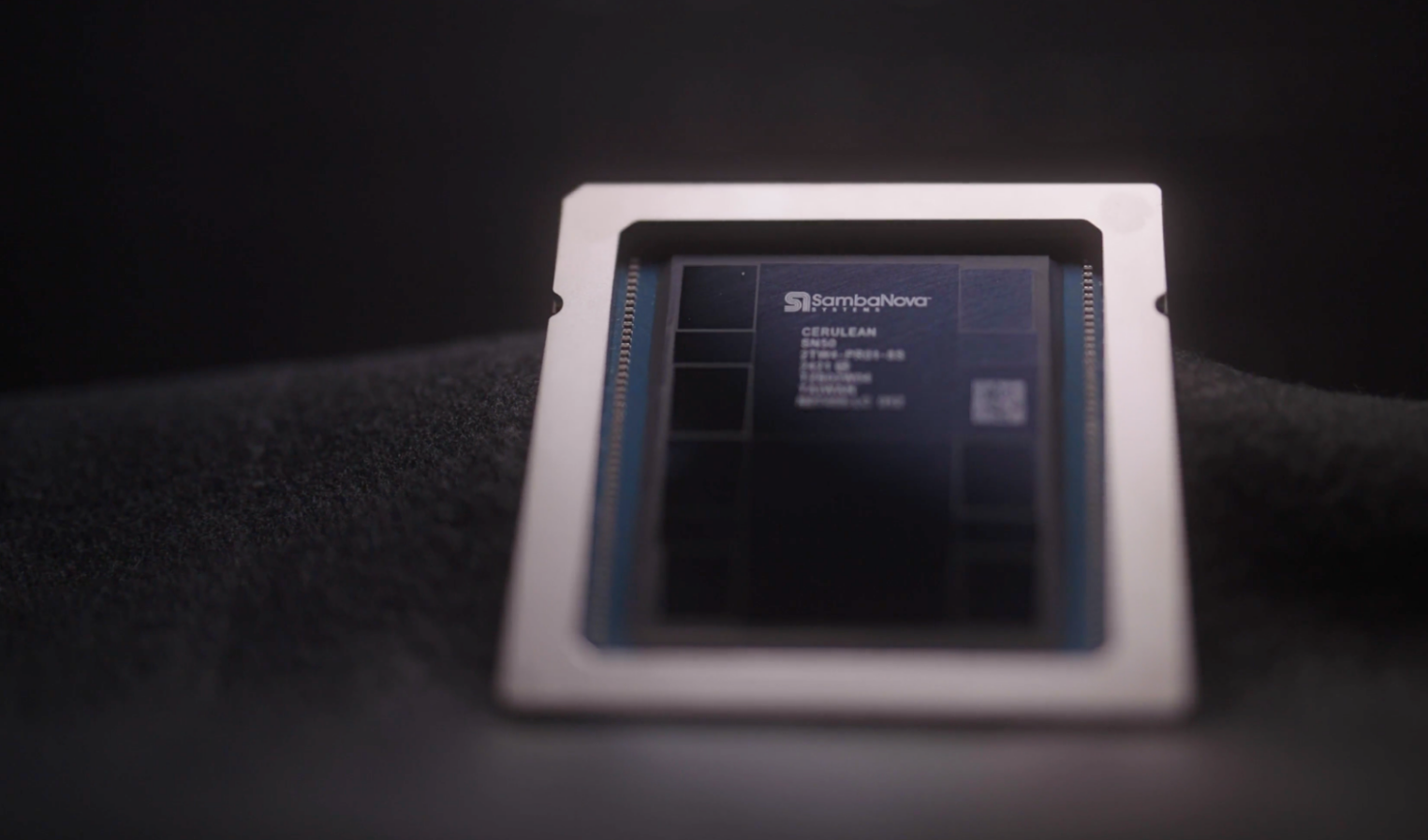

SambaNova SN50 – GPU для инференса

Компания SambaNova Systems показала пятое поколение своих AI-ускорителей – SambaNova SN50. GPU рассчитаны в первую очередь на инференс больших языковых моделей.

Новинка пришла на смену SambaNova SN40L образца 2023 года. Параллельно компания объявила о новом раунде инвестиций и технологическом сотрудничестве с Intel, которая решила поддержать стартап капиталом вместо прежней идеи покупки.

Технические характеристики

- 1,6 Пфлопс FP16.

- 3,2 Пфлопс FP8.

- Примерно в 2,5 раза быстрее SN40L в FP16.

- До пяти раз быстрее в FP8.

- Интерконнект 2,2 ТБ/с в каждом направлении между ускорителями.

- Три уровня памяти: 64 ГБ HBM2E (пропускная способность 1,8 ТБ/с), 432 МБ SRAM, от 256ГБ – 2ТБ DDR5.

Такой набор памяти позволяет держать очень большие модели прямо в системе — уже сейчас заявлена поддержка сетей до 10 трлн параметров и контекст до 10 млн токенов.

Компания также заявляет, что SN50 быстрее NVIDIA B200 в задачах инференса агентных моделей. Архитектура позволяет быстро переключать модели между SRAM и HBM и выгружать KV-кеш без серьезной задержки. Это полезно для сервисов, где модели постоянно меняются.

Для готовых систем показали стойку SambaRack SN50 — это целых 16 ускорителей в одной системе, энергопотребление около 20 кВт и масштабирование до 256 чипов в кластере. Поставки SN50 ожидаются во второй половине 2026 года.

Можно сказать, SN50 — еще один пример того, как рынок AI-ускорителей пытается уйти от универсальных GPU. SambaNova Systems делает ставку на потоковую архитектуру и большие объемы локальной памяти – подход, близкий к специализированным inference-ASIC. Появление все большего числа альтернатив NVIDIA в целом можно только приветствовать, особенно для задач инференса: в отличие от обучения моделей, такие нагрузки гораздо меньше завязаны на специфические библиотеки CUDA и экосистему NVIDIA.

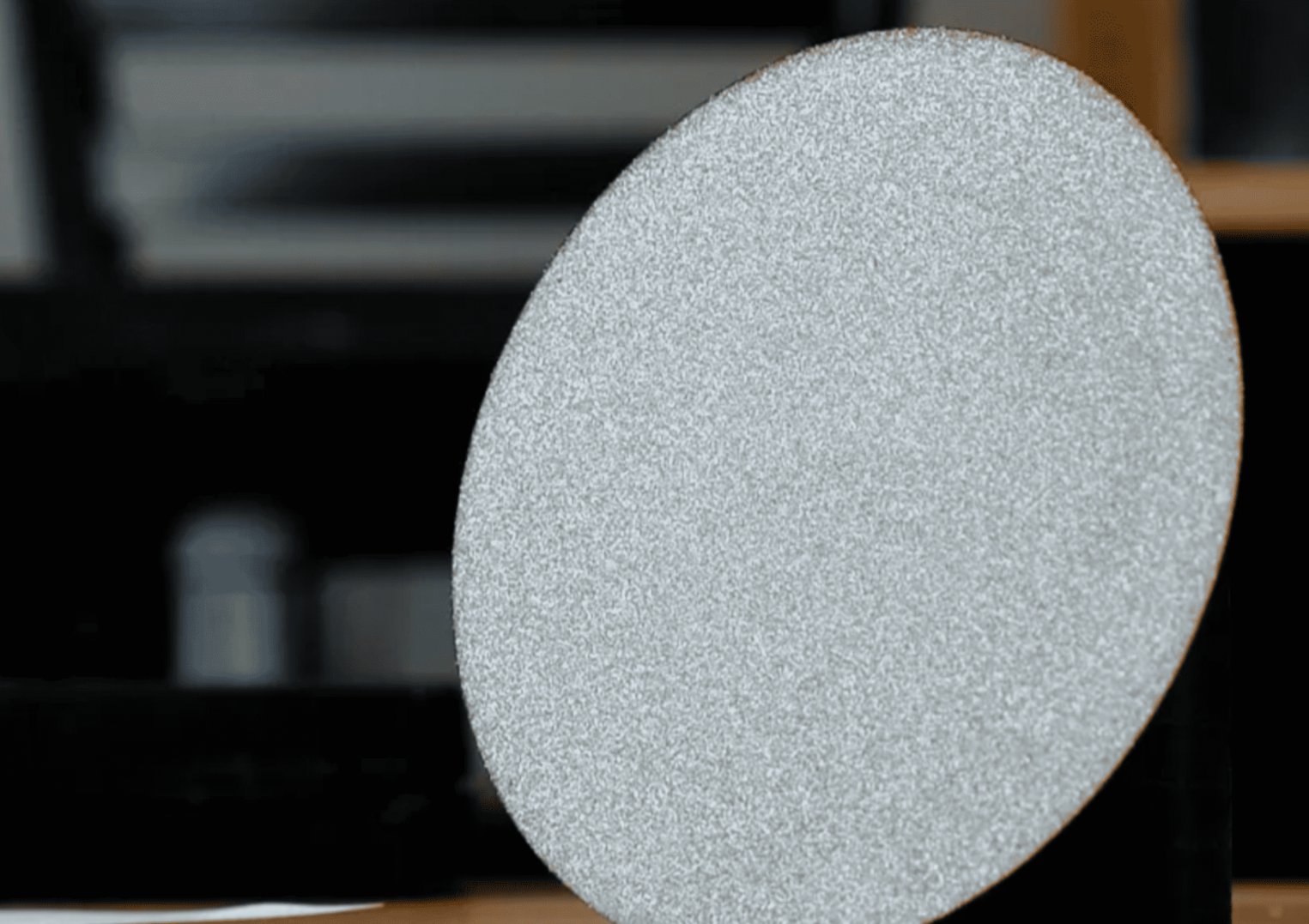

Diamond Cooling — алмазная система охлаждения серверов

Стартап Akash Systems объявил о начале поставок серверов с необычной системой охлаждения — Diamond Cooling. Главная идея — использовать синтетические алмазы в качестве теплопроводящего материала. Это попытка решить типичную проблему современных AI-серверов: чипы становятся горячее быстрее, чем успевают улучшаться системы охлаждения.

В основе поставляемых систем — ускорители NVIDIA H200 или AMD Instinct MI350X, а вот отвод тепла реализован нетипичным способом. В систему включены теплопроводящий слой на основе синтетического алмаза, что позволяет достичь теплопроводности примерно в пять раз выше, чем у меди, а также рабочей температуры серверной среды в пределах 50 °C. Для сравнения: большинство дата-центров стараются держать температуру воздуха примерно 24–29 °C, чтобы GPU работали стабильно. По данным компании, использование алмазного теплоотвода гарантирует до +15 % прироста энергоэффективности (FLOPS/Вт), уменьшение теплового троттлинга, снижение нагрузки на систему охлаждения ЦОД.

Алмазное охлаждение звучит как маркетинговая экзотика, но идея вполне инженерная: алмаз — лучший теплопроводник среди известных материалов. Если заменить медные тепловые интерфейсы на алмазные, тепло от GPU действительно можно отводить быстрее. Главный вопрос — в том, сколько это будет стоить. Алмазные элементы явно дороже классических медных радиаторов или водяного охлаждения. Однако на фоне стоимости всей системы, особенно уровня NVIDIA HGX или AMD Instinct, увеличение цены охлаждения может быть нивелировано.

Материнские платы и платформы

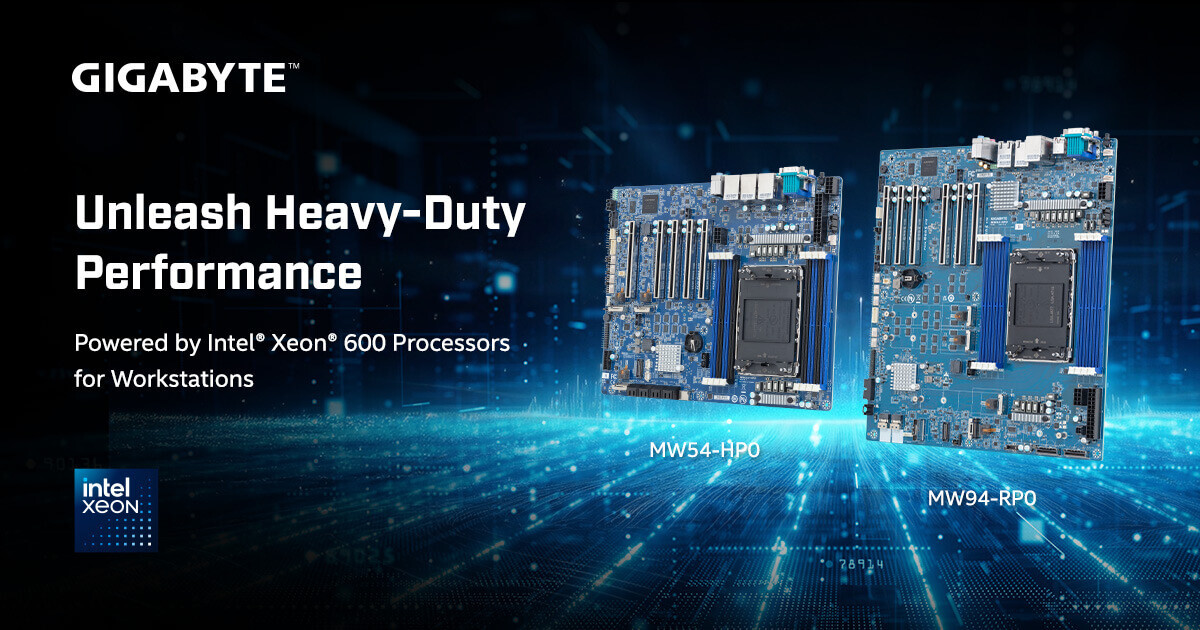

Материнские платы Giga Computing для Intel Xeon 600

Подразделение Giga Computing на заставило себя долго ждать и представило две материнские платы для новых процессоров Intel Xeon 600. Речь о моделях MW54-HP0 и MW94-RP0 на чипсете Intel W890.

Характеристики базовой версии, MW54-HP0

- 4 канала DDR5.

- 8 слотов RDIMM-6400 / MRDIMM-8000.

- До 80 линий PCIe 5.0.

- 5 слотов PCIe 5.0 x16.

- 3 M.2 (PCIe 4.0 x4), 8 портов SATA.

- Форм-фактор — ATX.

Характеристики старшей платы, MW94-RP0

- 8 каналов DDR5.

- 128 линий PCIe 5.0.

- 6 слотов PCIe 5.0 x16.

- 5 слотов PCIe 5.0 x16.

- 3 M.2 (PCIe 4.0 x4), 8 портов SATA.

- Форм-фактор — ATX.

Обе платы оснащены BMC-контроллером ASPEED AST2600 для удаленного управления. Производитель пока не раскрывает стоимость платы, однако если старшая модель окажется дороже 1 000 $, возникает вопрос о целесообразности ее использования в сравнении с полноценным серверным сегментом процессоров и платформ.

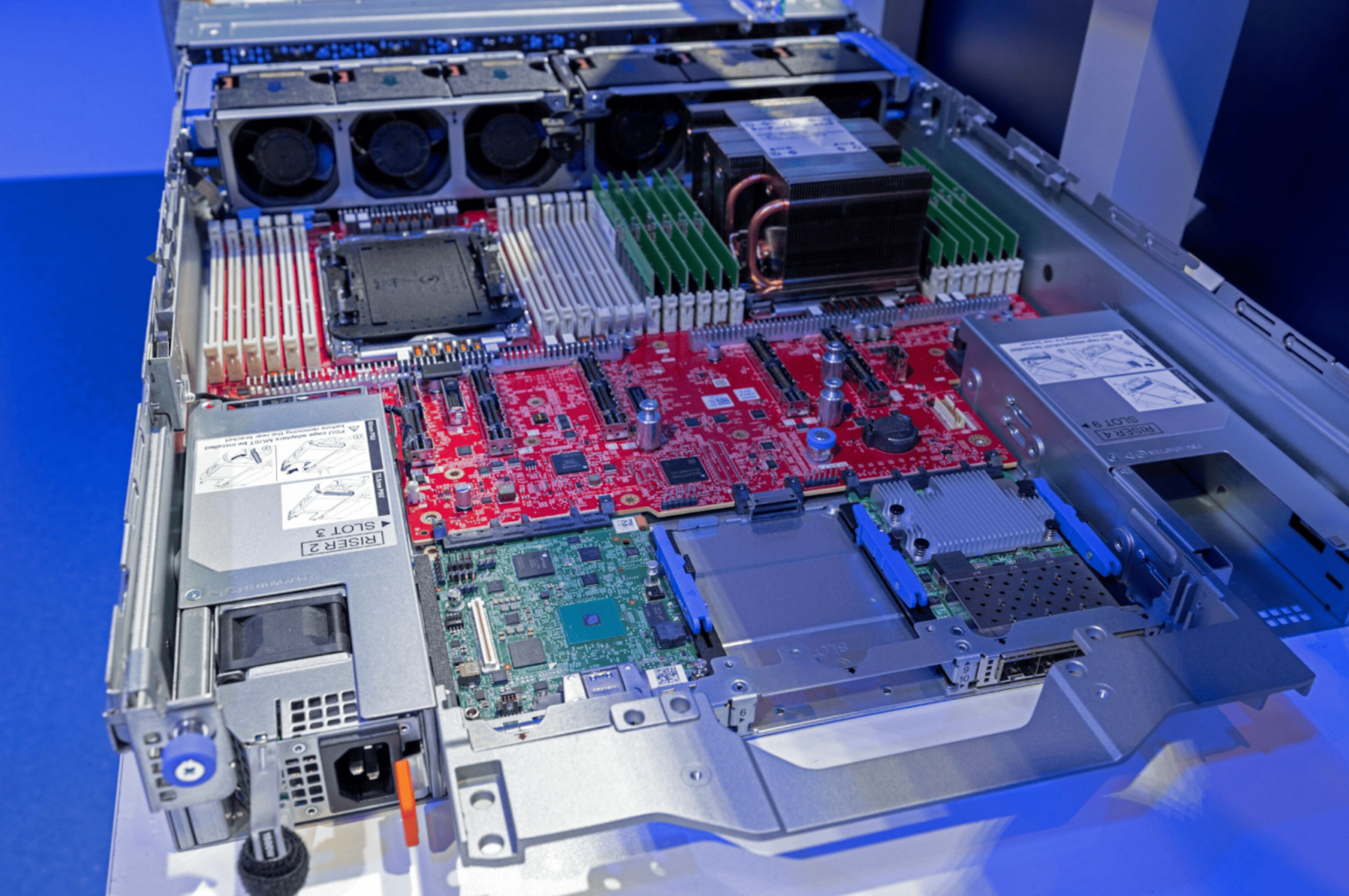

Supermicro MicroBlade для 40 узлов на базе AMD EPYC 4005

Компания Supermicro выпустила конфигурацию MicroBlade на базе процессоров AMD EPYC 4005 Grado.

Технические характеристики

- Сокет AM5 (LGA-1718).

- Процессоры до 16 ядер / 32 потоков.

- TDP до 110 Вт.

- 2 слота DDR5-5600.

- Максимум 128 ГБ ОЗУ.

- 2 × 25GbE (контроллер Broadcom BCM57414).

- BMC ASPEED AST2600.

- Накопители: 1× M.2 NVMe, 2× EDSFF E1.S.

Впечатляет, что шасси MicroBlade высотой в 6U вмещает до 40 серверных узлов. Если собрать 48 юнитовую стойку целиком, то число серверов вырастет до 320. Такие системы решают задачи уплотнения в дата-центра и существенно экономят место. Для сравнения: мы в Selectel используем схожие системы для конфигураций BL25 с процессорами 9950X, однако один такой узел вмещает только 12 серверных узлов.

Gigabyte B683-Z80-LAS1 — 6U-сервер на 10 узлов для AMD EPYC 9005 Turin

Компания Gigabyte Technology не отстает от Supermicro с компактными решениями и показали сервер Gigabyte B683-Z80-LAS1 для старшей линейки процессоров AMD.

Технические характеристики

- 10 узлов в шести юнитах.

- 2 × CPU на узел: AMD EPYC 9005 Turin или EPYC 9004 Genoa, сокет SP5 (LGA 6096).

- TDP до 500 Вт

- 12-канальная DDR5 с 24 слотами на узел, поддержка модулей 4 800/6 400.

- BMC: ASPEED AST2600, Mini-DP.

- Порт управления: 1GbE RJ45.

- 3 × низкопрофильные PCIe 5.0 x16.

- 2 × E3.S NVMe.

- Прямое жидкостное охлаждение CPU, памяти, накопителей и карт расширения.

- 12 × блоков по 3 200 Вт, сертификат 80 PLUS Titanium.

По сравнению с предыдущими решениями, где жидкостное охлаждение охватывало только CPU, здесь прокачана вся «критическая цепочка»: память, NVMe, PCIe‑карты. Gigabyte пытается уместить стойку 10 узлов там, где раньше стояли три‑четыре обычных сервера. Не самое популярное решение именно для старших линеек процессоров, ранее производители делали больший упор на младший серверный сегмент. Понаблюдаем за развитием решений от Gigabyte.

Диски

Seagate Exos 44ТБ HDD на базе HAMR

Компания Seagate Technology объявила о начале поставок новой модели из линейки Seagate Exos объемом 44 ТБ для дата-центров. Основой накопителей стала технология HAMR (heat-assisted magnetic recording) — запись с локальным нагревом магнитного слоя. Именно она должна обеспечить дальнейший рост емкости HDD, так как пока что флеш-накопители остаются слишком дорогими для холодных архивов.

Новые диски используют фирменную платформу Mozaic 4+, что обеспечивает емкость до 44 ТБ, форм-фактор 3,5″ (LFF), скорость вращения до 7 200 об/мин. Накопитель состоит из 10 магнитных пластин, на каждую приходится примерно 4,4 ТБ. Тип записи — CMR, а устойчивая скорость передачи данных — около 300 МБ/с. Для HDD такого объема это вполне типичные цифры: главная задача здесь не производительность, а максимальная плотность хранения. По сравнению с моделями меньшего объема, новые накопители позволяют заметно сократить количество дисков в больших системах хранения. В масштабах инфраструктуры это означает меньше стоек, питания и охлаждения.

Сетевое оборудование

Cisco Silicon One G300 – 102,4-Тбит/с коммутатор для AI-кластеров

Компания Cisco анонсировала новый сетевой чип Cisco Silicon One G300 с пропускной способностью 102,4 Тбит/с. Он рассчитан на инфраструктуру больших AI-кластеров с тысячами GPU.

Технические характеристики

- 102,4 Тбит/с суммарной пропускной способности.

- 512 блоков SerDes 200G.

- Поддержка портов до 1,6 Тбит/с.

- Новые оптические модули OSFP 1.6T.

Согласно оценке Cisco, кластер на 128 тыс GPU можно собрать примерно на 750 коммутаторах — ранее для такой конфигурации требовалось около 2 500 устройств.

Внутри G300 используется единый общий буфер пакетов без жесткого разделения между портами. Это упрощает работу с всплесками трафика, что является типичной проблемой для распределенного обучения моделей.

Также в чип добавили: динамическую балансировку потоков, систему сетевой телеметрии в реальном времени и программируемую архитектуру для внедрения новых функций после развертывания. На базе G300 компания уже показала обновленные системы Cisco Nexus 9000 и Cisco 8000 Series с воздушным и жидкостным охлаждением. Кстати, сетевые устройства Nexus работают под управлением Cisco NX-OS, а системы серии 8000 могут использовать альтернативные ОС, включая SONiC.

По позиционированию G300 конкурирует с Broadcom Tomahawk 6 и сетевой платформой NVIDIA Spectrum-X. И конкуренция не на ровном месте: если раньше основной задачей дата-центров было просто «соединить серверы», то в эпоху AI сеть стала почти таким же узким местом, как и сами GPU. Судя по темпам роста скорости, скоро кабель между стойками будет передавать данных больше, чем весь интернет-канал среднего провайдера лет десять назад.

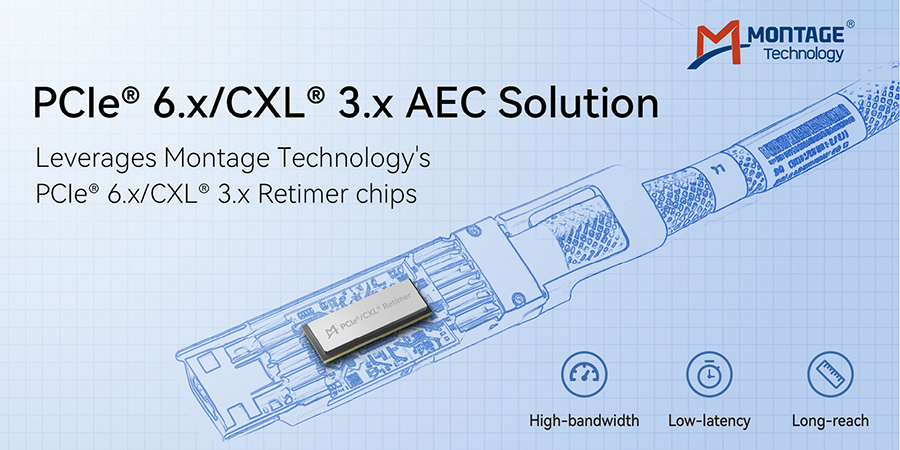

Montage Technology — активные PCIe 6/CXL 3 кабели для ЦОД

Компания Montage Technology представила новые активные электрические кабели (AEC) для стандартов PCIe 6.x и CXL 3.x. Они рассчитаны на инфраструктуру дата-центров с высокими требованиями к пропускной способности и низкой задержке — например, для AI‑кластеров и высокопроизводительных вычислений (НРС). Идея простая: при росте числа ускорителей в стойках активные кабели с ретаймерами позволяют сохранить целостность сигнала.

Технические характеристики

- Стандарт: PCIe 6.x / CXL 3.x.

- Поддержка ретаймеров для компенсации потерь сигнала на длинных линиях.

- Высокоплотный форм-фактор OSFP-XD.

- Блоки SerDes и DSP-архитектура для обработки сигналов.

- Функции мониторинга и диагностики каналов связи.

Кабели уже протестированы на совместимость с CPU и xPU, коммутаторами PCIe, сетевыми адаптерами и высокопроизводительными хранилищами. На практике такие AEC нужны там, где несколько десятков GPU или xPU обмениваются данными через одну стойку или суперузел.

Если раньше для больших суперузлов приходилось ставить сотни маленьких коммутаторов, то с кабелями AEC можно увеличить расстояние между узлами без падения пропускной способности. В общем, PCIe 6 + CXL 3 в активном кабеле — это как дать системе очки: сигнал видит дальше и не теряет в качестве.