Сценарии использования объектного хранилища S3

Ключевые возможности S3

Хранение данных в 3 копиях

Все объекты хранятся в трех копиях на разных серверах, в разных стойках и сегментах дата-центров уровня Tier III. Это гарантирует отказоустойчивость: если что-то произойдет с сервером, стойкой или даже серверной комнатой, с данными все будет в порядке.

Автоматическое масштабирование

Храните большие объемы данных и не думайте о месте на дисках. У хранилища нет ограничений по объему — увеличим его насколько потребуется и сделаем это незаметно. Масштабирование ресурсов происходит автоматически.

Доступность сервисов

Делаем все, чтобы у вас всегда был быстрый доступ к данным вне зависимости от класса хранения, типа данных и уровня пользовательской нагрузки. Убедиться в стабильной работе наших продуктов можно в статус-панели.

Управление доступом с помощью IAM

Вы сами управляете доступом к данным: можете давать его одним и ограничивать другим. Кроме того, можно настроить федерации удостоверений для входа в Selectel через SSO. О том, как устроена система управления пользователями и ролями рассказали на странице IAM.

Соответствие 152-ФЗ (УЗ-1), ФСТЭК № 21, PCI DSS, ISO 27001, 27017, 27018

S3 от Selectel соответствует российским и международным требованиям и стандартам. Перечислили самые важные на странице о безопасности.

Удобная панель управления

Работайте с хранилищем через S3 API, Swift API, Selectel Storage API, или в нашей панели управления Selectel.

Зарегистрируйтесь в панели управления, чтобы пользоваться нашими продуктами

Вы всегда можете получить бесплатную консультацию по телефону 8 800 555-06-75 или по почте sales@selectel.ru.

Экономьте до 30% на хранении данных

- Для объектов, которые будут очень редко читать и изменять: логов, бэкапов и документов.

- Тип репликации — Erasure Coding.

- Стоимость хранения — самая низкая, а запросов и трафика — самая высокая.

От 0,81 ₽/мес.

- Для хранения редко используемых данных: резервных копий, архивов.

- Стоимость хранения ниже, чем в стандартном хранилище. Стоимость запросов и трафика — выше.

От 1,14 ₽ /мес.

- Для часто используемых данных: анализ Big Data, хранение и доставка мультимедиа.

- Стоимость хранения выше, чем в холодном хранилище. Стоимость запросов и трафика — ниже.

От 2,33 ₽ /мес.

- Изолированное хранилище, спроектированное под ваши бизнес-задачи.

- Для хранения данных с повышенными требованиями к безопасности.

Аренда S3-совместимого хранилища за несколько минут

Почему S3 — в Selectel

50+ продуктов в экосистеме

Простое подключение к другим продуктам

Оплата по потреблению

Техподдержка, которая быстро отвечает

Собственная инфраструктура

Мощное оборудование

Простая миграция

Компании, которые нам доверяют

Наши клиенты

Истории успеха

Как мы помогли Wfolio организовать быстрый доступ к петабайтам фотографий в облаке

Wfolio требовалось организовать инфраструктуру для стабильной работы конструктора сайтов и надежного хранения файлов клиентов. Рассказываем, как компании удалось решить эту задачу при помощи Selectel.

2,5+ петабайта

данных загрузили в S3 от Selectel

800+ тысяч

страниц создано на сайтах только за последний год

Как мы помогли Правовед.ru справиться с нагрузкой, когда количество посетителей сайта увеличилось в два раза

Правовед.ru предстояло мигрировать от зарубежного провайдера и разделить монолит на два отказоустойчивых сервиса. Для этого, в том числе, требовалось перенести файлы пользователей. Рассказываем, как это удалось при помощи Selectel.

250+ тысяч

уникальных пользователей посещало проекты в сутки

1+ Тб

пользовательских файлов — счетов на оплату — было переведено в хранилище

Как мы помогли ЕДИНЫЙ ЦУПИС организовать инфраструктуру, не зависящую от больших нагрузок

ЕДИНОМУ ЦУПИС требовалось обеспечить бесперебойную работу высоконагруженной платежной платформы. Рассказываем, как в этом помог Selectel.

1,8+ млн

моментальных транзакций обрабатывается в сутки

99,99%

uptime внутренних сервисов

Как RobotMIA удалось запустить более 400 голосовых роботов в облаке

В компании хотели создать комфортные условия для пользователей при общении с голосовыми роботами, а также научить тех предоставлять максимально релевантные ответы. Все это удалось благодаря размещению сервисов на инфраструктуре Selectel.

1–2 секунды

среднее время ответа голосового робота

4

региона ЦОД поддерживают инфраструктуру клиента

Рассчитайте стоимость аренды объектного хранилища S3

Бакет

0,81 ₽/мес.Класс хранилища

Расположение

Объем хранения

Исходящий внутри Selectel

Трафик между S3 и другими продуктами Selectel не тарифицируется на стороне S3.

Исходящий трафик в интернет

Запросы

Внесите продукт в расчет, чтобы отобразилась итоговая стоимость инфраструктуры

Цена всех услуг указана с учетом НДС 22%

Свяжитесь с нами и мы поможем

Входит в стоимость

Входит в стоимость

- Исходящий трафик внутри Selectel

- Создание 2 000 контейнеров, больше — по запросу

- Поддержка собственных доменов и сертификатов

- Хранение данных в трех экземплярах независимо от класса хранения

- Управление сервисом с помощью API или Terraform

- Защита от DDoS-атак

- Круглосуточная техподдержка

Облачное хранилище S3 от Selectel соответствует российским и международным стандартам

152-ФЗ

ISO

- ISO/IEC 27001. Соответствие гарантирует, что мы эффективно управляем безопасностью информации.

- ISO/IEC 27017. Этот стандарт расширяет предыдущий и регулирует оказание облачных услуг.

- ISO/IEC 27018. Позволяет обрабатывать персональные данные в облаке.

PCI DSS

Безопасность хранения данных — на всех уровнях

Система управления доступом

IAM-система разграничивает доступ к ресурсам и данным, а также определяет роли пользователей. В панели можно увидеть только ту функциональность, которая доступна пользователю в рамках его роли. Инструмент будет особенно полезен, если в вашей компании много подразделений и администраторов.

Политики доступа к бакетам (Bucket Policy)

Политики доступа к бакетам определяют, кто может выполнять действия с объектами и бакетами и какие это действия. Bucket Policy позволяет создавать более гибкие и точные настройки безопасности, чем традиционная модель доступа на основе ролей.

Защита от DDoS-атак

Для всех сервисов облачной платформы Selectel подключена базовая защита от DDoS Selectel — бесплатно. Она помогает отражать атаки на уровне сетевых протоколов L3, L4.

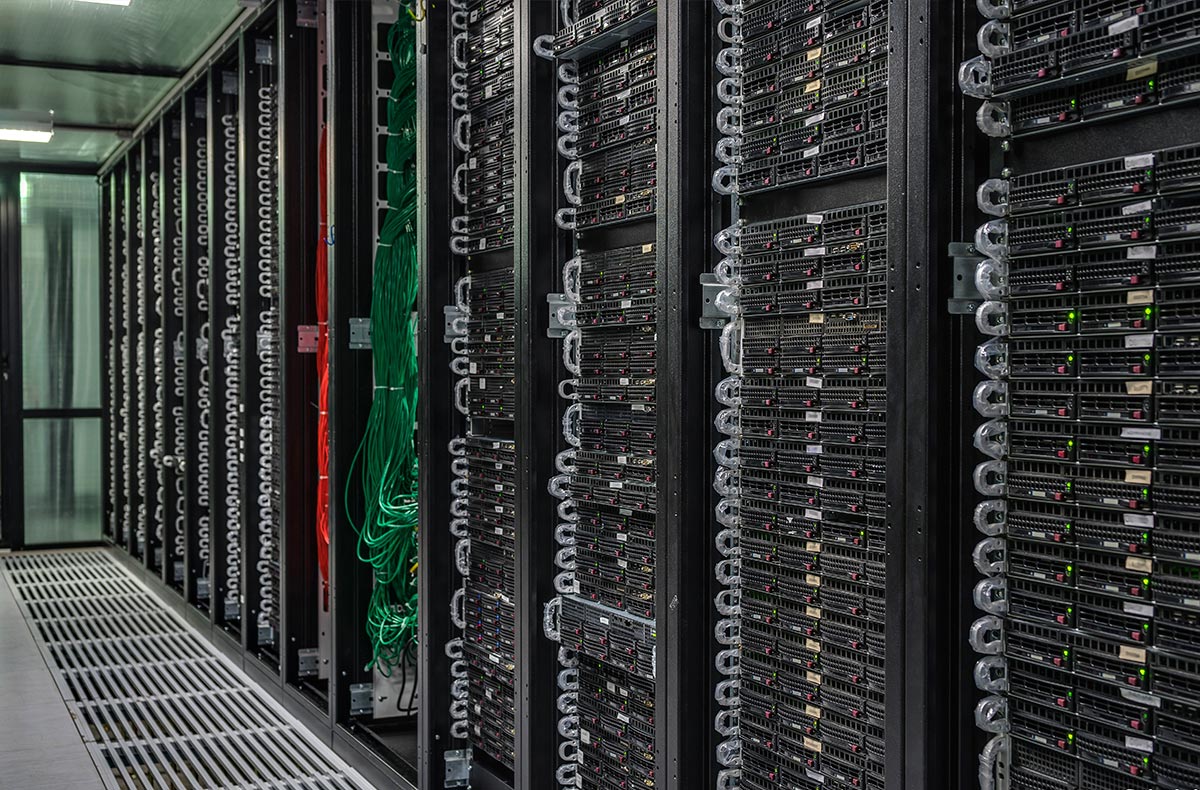

S3 — на базе дата-центров уровня Tier III

Группа дата-центров в Дубровке

2 439 м²

996

50+

Группа дата-центров на Берзарина

2 777 м²

1 420

50+

Описание сервиса

Быстрый старт

Работа с хранилищем S3

Работа с объектами

Работа с бакетами

Инструменты для работы с хранилищем

Управление пользователями и ролями

Про S3

Какие задачи решает S3-хранилище?

S3 (cloud object storage, или s3 cloud storage) подходит для хранения данных любых форматов. В нем можно размещать как данные высоконагруженных сервисов, к которым приходится часто обращаться, так и редко используемые данные с долгим жизненным циклом: архивы, логи, журналы, базы данных, истории запросов, финансовую отчетность. Мы бережно разместим в хранилище массивы данных в исходном виде и будем четко следовать настроенным политикам доступа.

В S3 можно хранить бэкапы. В таком случае оно может помочь быстро восстановить данные при сбоях. Самый надежный вариант — когда сервер и хранилище с резервными копиями размещены в разных зонах доступности.

S3 (Cloud Object Storage или S3 Cloud Storage) подходит для хранения данных любых форматов. В нем можно размещать данные высоконагруженных сервисов, к которым приходится часто обращаться, и редко используемые данные с долгим жизненным циклом: архивы, логи, журналы, базы данных, истории запросов, финансовая отчетность, хранение данных для AI/ML, Big Data, активные аналитические пайплайны и другое.

Чем S3 отличается от файлового и блочного хранилищ?

Выделяют три типа облачных хранилищ: файловые, блочные и объектные.

В файловом хранилище хранение организовано по принципу иерархии: данные хранятся в файлах, файлы — в папках, папки объединены в подкаталоги и каталоги. В таком хранилище просто ориентироваться, поэтому его часто используют для совместной работы. Файловое хранилище подходит для больших объемов структурированных данных, однако из-за разветвленной иерархии плохо масштабируется.

В блочном хранилище файлы делятся на равнозначные блоки. У каждого из них есть свой идентификатор — по нему система хранения собирает блоки обратно в файлы. Блочное хранилище подходит для интеграции с корпоративными базами данных благодаря низким задержкам и высокой скорости ввода-вывода. Однако данными в блочном хранилище сложно управлять из-за отсутствия метаданных и большого количества настроек. Кроме того, такой тип хранилища один из самых дорогих, так как приходится платить за все пространство, даже если оно не занято данными.

В S3 файлы хранятся как объекты с набором свойств. Свойства хранят идентификатор и метаданные. В отличие от файлового хранилища, в S3 нет иерархии и его легко масштабировать. При этом приложениям удобно обращаться к данным: поддерживается доступ через различные протоколы и API.

Подробнее о сходствах и различиях файловых, блочных и объектных хранилищ в статье блога Что такое облачные хранилища и как используются.

Чем холодное хранилище отличается от стандартного?

- Стандартное хранилище лучше подойдет для раздачи статического контента и других данных, к которым нужен быстрый доступ: медиаконтента, данных с сайтов, документов, писем. Стоимость трафика и запросов здесь ниже, но выше стоимость хранения.

- Холодное хранилище выгоднее использовать для архивного хранения редко используемых данных. Если вам нужно разместить резервные копии, архивы, логи, отчеты и другие подобные объекты, такой класс хранения поможет добиться экономии: стоимость хранения будет ниже, а стоимость запросов и трафика — выше.

Какие данные можно хранить в S3?

S3 подходит для хранения неструктурированных и полуструктурированных данных:

- к неструктурированным данным относят аудио и видео, фото и изображения, документы, электронные письма, веб-страницы, резервные копии, архивы, логи, образы виртуальных машин, данные аналитики и дата-сеты для машинного обучения;

- к полуструктурированным данным относят архивные файлы, XML- и веб-файлы.

Что такое метаданные и зачем они нужны?

Метаданные — это информация об объектах, которые размещены в хранилище: название, тип, размер, дата создания. Также можно добавлять собственные метаданные.

С помощью метаданных проще управлять хранилищем: сортировать, искать и удалять нужные объекты, назначать политики хранения, анализировать данные и многое другое.

Про работу с S3

Как начать работу с S3?

Подробнее о начале работы с S3 в инструкции S3: Быстрый старт.

- Пополните баланс.

- Создайте бакет.

- Настройте доступ к бакету.

- Установите лимиты.

- Выберите инструмент для работы с S3.

- Загрузите объекты.

Как мигрировать в S3 от Selectel из других хранилищ?

Перенести данные можно с помощью сторонних инструментов для работы с хранилищем — например, Rclone.

Подробнее о том, как подготовить площадку для миграции и осуществить миграцию данных, в инструкции Миграция в S3.

Как управлять доступом к S3?

Вы можете:

- выбирать тип бакетов — публичный или приватный;

- создавать пользователей с разными разрешениями. Разрешения определяют, определяет, какие операции и над какой группой ресурсов может выполнять пользователь;

- настраивать политики доступа к бакетам.

Подробнее в инструкции Управлять доступом в S3.

Какие инструменты доступны для работы с S3?

Работать с хранилищем S3 можно:

- через S3 API, Swift API и Object Storage API. Для работы через API можно использовать различные инструменты (Rclone, AWS CLI, s3cmd и другие);

- по протоколу FTP. Он использует Swift API для трансляции запросов в S3;

- через панель управления Selectel, которая выполняет запросы в S3 через Swift API и Object Storage API. У панели управления есть ограничения на работу с большим количеством объектов и с объектами большого размера;

- с помощью Terraform .

Какие действия можно выполнять с объектами?

Вы можете:

- загружать, перемещать, копировать, скачивать и удалять объекты;

- включать версионирование, чтобы хранить предыдущие версии объектов;

- получать ссылки на объекты или обращаться к ним через API.

Подробнее в разделе Работа с объектами.

С какой скоростью данные загружаются в хранилище и выгружаются из него?

Скорость загрузки и выгрузки данных зависит от многих факторов — например, размера файлов, скорости интернет-соединения, пропускной способности канала, использования специальных утилит.

Могу ли я подключить бакет S3 как сетевой диск?

Да, вы можете подключить бакет как сетевой диск по FTP или с помощью сторонних утилит, например Rclone, WinSCP и других.

Подробнее о том, как монтировать бакет S3 в Linux, читайте в инструкции блога Как монтировать бакет объектного хранилища в Linux.

Про ограничения и безопасность

Как защищены данные в S3?

S3 построено на базе программно-определяемой распределенной системы хранения данных, которая использует распределенные методы защиты. Каждый объект сохраняется в нескольких независимых вариантах или преобразуется в набор специальных блоков, из которых его можно восстановить при необходимости. Это позволяет системе продолжать работу даже при отказе части инфраструктуры.

Наши дата-центры соответствуют международным стандартам Tier III и строго охраняются: камеры видеонаблюдения круглосуточно следят за дата-центрами внутри и снаружи, а доступ к оборудованию есть только у наших инженеров.

Есть ли ограничения по объему хранимых данных?

Ограничений нет, вы можете хранить любое количество объектов и любой объем данных — хранилище масштабируется автоматически.

В хранилище есть ограничение количества бакетов и запросов к API, подробнее в инструкции Ограничения S3.

Про стоимость и оплату

Сколько стоит S3?

S3 оплачивается по модели pay-as-you-go — оплата за потребленные ресурсы списывается каждый час.

На стоимость влияет класс хранения и потребление ресурсов:

- объем хранения;

- объем исходящего трафика;

- количество запросов к API — операций чтения объектов (GET, HEAD) и добавления, изменения и копирования объектов (PUT, POST, COPY).

Рассчитать примерную стоимость использования S3 можно в калькуляторе ресурсов.

Как S3 помогает снизить затраты?

- вы платите только за ресурсы, которые потребляете фактически — объем хранения, исходящий трафик и количество запросов к API;

- вы можете выбрать класс хранилища, который будет выгоден для ваших задач. Стандартное хранение больше подходит для данных, к которым требуется быстрый доступ, а холодное — для данных, к которым нужно обращаться редко.

Объединяйте S3 и другие продукты Selectel для решения разных задач

Собрать инфраструктуру для работы с данными

Выделенные серверы

- Функционируют на оборудовании, недоступном для виртуальных машин.

- Позволяют экономить за счет длительной предсказуемой нагрузки.

Облачные серверы

- Подходят для нагрузок, которые могут моментально масштабироваться.

- Поддерживают S3 и другие протоколы передачи данных.

Managed Kubernetes

- Упрощает процесс развертывания, масштабирования и обслуживания контейнерной инфраструктуры.

- Помогает построить микросервисную архитектуру и процесс CI/CD, ускорить релизы.

Организовать сеть

Глобальный роутер

- Связывает физическую и облачную инфраструктуру в изолированную приватную сеть.

- Объединяет серверы из разных регионов и пулов внутри Selectel.

CDN

- Ускоряет загрузку статического контента со стороны пользователей.

- Помогает снизить нагрузку на собственные серверы.

Direct Connect

- Связывает ваши сервисы с инфраструктурой Selectel или зарубежными гипероблаками.

Домены

- Регистрация, продление и перенос доменов .RU/.РФ прямо в панели управления Selectel.

DNS

- Система, которая хранит все домены и информацию о них.

- Преобразует запросы сайтов в IP-адреса, понятные для серверов.

SSL-сертификаты

- Выпуск сертификатов для безопасной передачи данных между пользователями и сайтом.

Защитить данные от сетевых атак

Защита от DDoS-атак

- Борется с потоками нежелательного трафика из внешней сети.

- Фильтрует атаки на уровне приложений L7, а также ускоряет загрузку сайта для пользователей.

Защита приложения (WAF)

- Анализирует трафик и фильтрует подозрительный.

- Предотвращает целевые атаки.

Организовать машинное обучение и обработку данных

ML-платформа

- Преднастроенная инфраструктура Selectel для обучения и развертывания ML-моделей.

- Бесплатный двухнедельный тестовый период.

Data Science Virtual Machine

- Облачные серверы с предустановленными библиотеками для машинного обучения: Keras, TensorFlow, PyTorch, scikit-learn и другими.

- Запуск JupyterLab без консоли прямо из браузера.

Data Analytics Virtual Machine

- Облачные серверы с предустановленными библиотеками для обработки и анализа данных: Jupyter Lab, Prefect, Apache Superset и другими.

- Встроенные Jupyter-ноутбуки с примерами кода и гайдами.

Собрать инфраструктуру для работы с данными

Выделенные серверы

- Функционируют на оборудовании, недоступном для виртуальных машин.

- Позволяют экономить за счет длительной предсказуемой нагрузки.

Облачные серверы

- Подходят для нагрузок, которые могут моментально масштабироваться.

- Поддерживают S3 и другие протоколы передачи данных.

Managed Kubernetes

- Упрощает процесс развертывания, масштабирования и обслуживания контейнерной инфраструктуры.

- Помогает построить микросервисную архитектуру и процесс CI/CD, ускорить релизы.

Организовать сеть

Глобальный роутер

- Связывает физическую и облачную инфраструктуру в изолированную приватную сеть.

- Объединяет серверы из разных регионов и пулов внутри Selectel.

CDN

- Ускоряет загрузку статического контента со стороны пользователей.

- Помогает снизить нагрузку на собственные серверы.

Direct Connect

- Связывает ваши сервисы с инфраструктурой Selectel или зарубежными гипероблаками.

Домены

- Регистрация, продление и перенос доменов .RU/.РФ прямо в панели управления Selectel.

DNS

- Система, которая хранит все домены и информацию о них.

- Преобразует запросы сайтов в IP-адреса, понятные для серверов.

SSL-сертификаты

- Выпуск сертификатов для безопасной передачи данных между пользователями и сайтом.

Защитить данные от сетевых атак

Защита от DDoS-атак

- Борется с потоками нежелательного трафика из внешней сети.

- Фильтрует атаки на уровне приложений L7, а также ускоряет загрузку сайта для пользователей.

Защита приложения (WAF)

- Анализирует трафик и фильтрует подозрительный.

- Предотвращает целевые атаки.

Организовать машинное обучение и обработку данных

ML-платформа

- Преднастроенная инфраструктура Selectel для обучения и развертывания ML-моделей.

- Бесплатный двухнедельный тестовый период.

Data Science Virtual Machine

- Облачные серверы с предустановленными библиотеками для машинного обучения: Keras, TensorFlow, PyTorch, scikit-learn и другими.

- Запуск JupyterLab без консоли прямо из браузера.

Data Analytics Virtual Machine

- Облачные серверы с предустановленными библиотеками для обработки и анализа данных: Jupyter Lab, Prefect, Apache Superset и другими.

- Встроенные Jupyter-ноутбуки с примерами кода и гайдами.

Что дальше?

Регистрация в панели управления

Чтобы подключить объектное хранилище, откройте панель управления Selectel. Если необходимо, пополните баланс удобным способом.

Создать аккаунтКонсультация перед заказом

По телефону 8 800 555-06-75 или по почте sales@selectel.ru— изучим задачу и подберем лучшее решение под ваш бюджет и требования.